IA y seguros en la empresa: dónde pueden aparecer las lagunas de cobertura

La IA ya no es solo una decisión operativa. También afecta a responsabilidad civil, D&O, E&O y ciber. Qué está cambiando en el mercado, qué pólizas revisar y qué controles mínimos exigir antes de tener un problema.

La relación entre la IA y los seguros en la empresa ya no es teórica. La inteligencia artificial ya está dentro de procesos reales de empresa. La inteligencia artificial ya está dentro de procesos reales de empresa.

Ese es el punto que muchas organizaciones todavía no han revisado con suficiente seriedad. Mientras la IA entra en marketing, ventas, atención al cliente, análisis, operaciones o recursos humanos, la conversación interna sigue siendo casi siempre operativa: productividad, ahorro de tiempo, automatización. Lo que queda fuera con demasiada frecuencia es la pregunta incómoda: qué ocurre cuando ese uso de IA provoca una reclamación y el seguro no responde como se asumía.

El mercado no se está moviendo de forma homogénea, pero sí en una dirección clara: más exclusiones específicas, más preguntas de underwriting y más exigencia de gobierno interno. No porque toda IA sea asegurable de la misma forma ni porque todo uso quede automáticamente fuera, sino porque el sector está intentando delimitar un riesgo que ya ha dejado de ser teórico.

Qué vas a encontrar aquí

Este artículo no plantea un rechazo a la IA ni un argumento alarmista. Explica qué está cambiando realmente en el mercado asegurador, cuándo un uso de IA puede convertirse en una reclamación real, qué pólizas merecen una revisión más seria y por qué el verdadero problema no suele estar en la herramienta, sino en la falta de gobierno, supervisión y trazabilidad.

Este contenido no sustituye asesoramiento legal ni mediación de seguros. Su función es ayudarte a entender el patrón de mercado y las preguntas que una dirección debería estar haciendo hoy a su corredor, aseguradora, asesoría jurídica y equipos internos. La cobertura depende siempre del wording concreto de cada póliza.

- El problema no es la herramienta: es la responsabilidad que activa

- Qué está cambiando realmente en el mercado asegurador

- Cuándo un uso de IA se convierte en una reclamación real

- Por qué muchas pólizas ya no cubren lo que antes sí

- ¿Puede haber responsabilidad penal por el uso de IA?

- El verdadero problema no es la IA: es la falta de gobierno y trazabilidad

- Qué debería revisar hoy una empresa sensata

- Preguntas frecuentes sobre IA, responsabilidad y seguros

1. El problema no es la herramienta: es la responsabilidad que activa

1.1. La IA ya no es un experimento interno

Durante un tiempo, la inteligencia artificial se trató en muchas empresas como una capa de apoyo: una herramienta para probar, acelerar tareas o ganar productividad en procesos secundarios. Ese marco ya se ha quedado corto. La IA está entrando en marketing, ventas, atención al cliente, análisis de datos, pricing, selección de talento, generación de contenidos, soporte documental y toma de decisiones operativas.

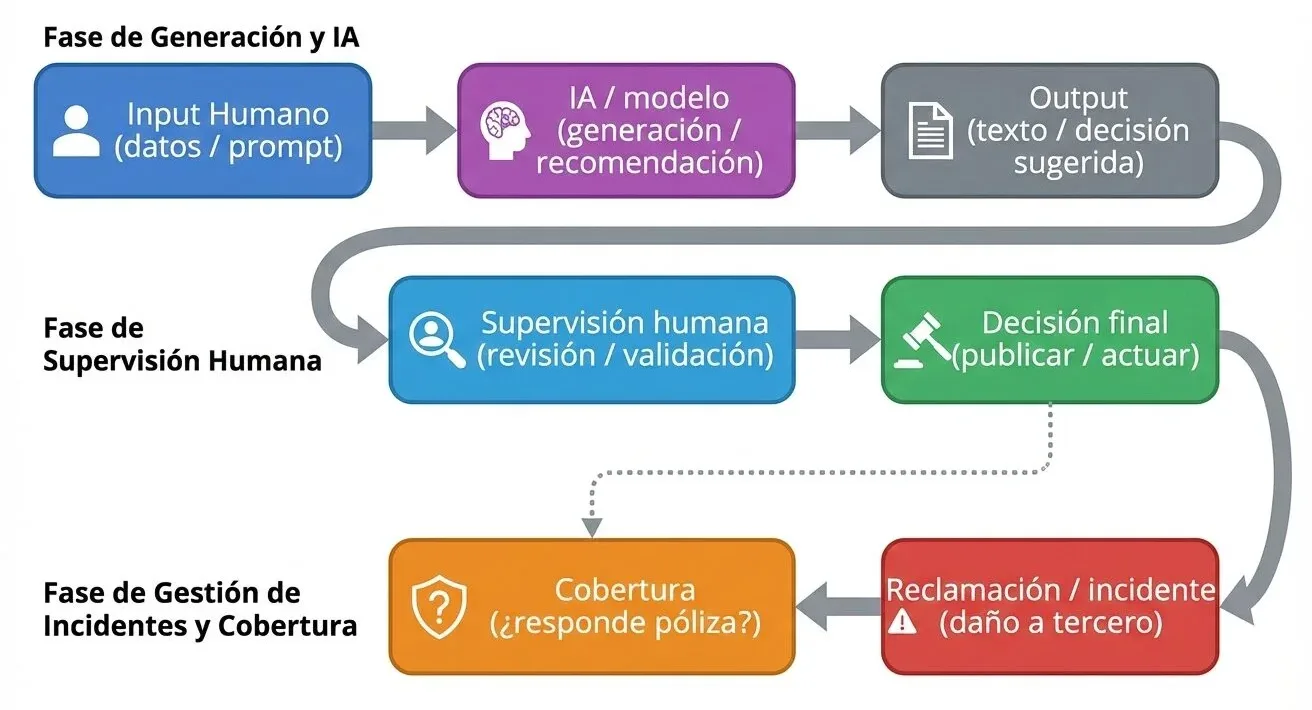

El cambio importante no es técnico. Es de exposición. En cuanto un sistema de IA interviene en un contenido que se publica, en una respuesta que recibe un cliente, en una recomendación profesional o en una decisión con impacto económico o legal, la conversación deja de ser solo operativa. Pasa a ser también una conversación de responsabilidad.

La IA puede acelerar tareas. Pero cuando entra en procesos con efectos reales, también cambia el mapa de riesgo.

1.2. Cuando un output genera daño, responde la empresa

Este es el punto que conviene fijar desde el principio. La IA no es un sujeto responsable. No responde el modelo. No responde el prompt. No responde la herramienta como si operara sola fuera del negocio. Responde la empresa que decide incorporar esa herramienta a un proceso real.

Si un contenido generado por IA difama, induce a error o vulnera derechos; si un chatbot promete algo que no existe; si una recomendación asistida por IA forma parte de un servicio profesional defectuoso; o si una decisión automatizada provoca un perjuicio económico o discriminatorio, la reclamación no se dirige contra “la inteligencia artificial” en abstracto. Se dirige contra la organización que la ha utilizado sin el nivel de control exigible en ese contexto.

Daños a terceros por contenidos, respuestas automáticas, errores de información, publicidad engañosa, vulneración de derechos o perjuicios económicos derivados de outputs generados o asistidos por IA.

Riesgo de que informes, análisis, propuestas, documentación o recomendaciones que forman parte de un servicio profesional incorporen errores, omisiones o decisiones defectuosas con impacto en un cliente.

Fallos de supervisión, ausencia de políticas, falta de controles razonables o permisividad ante un riesgo que ya está dentro del negocio y que afecta a decisiones, reputación o cumplimiento.

1.3. El riesgo no nace en la IA: nace en cómo se usa

Este matiz es importante porque evita dos errores frecuentes. El primero es tratar la IA como si fuera tóxica por definición. El segundo, igual de ingenuo, es verla como una simple herramienta neutral que no altera nada relevante mientras “ayude” y no “decida”. Ninguna de las dos lecturas sirve.

El riesgo real aparece cuando la empresa utiliza IA en procesos que producen efectos sobre terceros, sobre clientes, sobre empleados, sobre mercado o sobre decisiones internas con consecuencias reales. Ahí la discusión ya no es si la herramienta es útil, sino qué control existe, qué trazabilidad queda y si la organización puede defender que actuó con diligencia razonable.

La traducción a lenguaje directivo es bastante simple

Si estás introduciendo IA en procesos que generan outputs hacia fuera o influyen en decisiones relevantes, no estás solo ante una mejora de productividad. Estás introduciendo un riesgo que puede afectar a responsabilidad, contratos, cobertura y gobierno interno.

1.4. La pregunta correcta no es si la IA se equivocó

En muchas conversaciones sobre IA todavía se plantea mal el problema. Se discute si el sistema “alucinó”, si cometió un error o si funcionó por debajo de lo esperado. Eso puede ser técnicamente interesante, pero desde la perspectiva de empresa no es la pregunta central. La pregunta útil es otra: si ese error genera un daño, quién responde y bajo qué cobertura.

Ese cambio de enfoque es el que hace que este ya no sea un artículo sobre tecnología, sino sobre exposición empresarial. Y por eso el siguiente paso lógico no es hablar aún de regulación o de gobernanza interna, sino mirar cómo está reaccionando el mercado asegurador cuando este riesgo deja de ser hipotético y empieza a entrar en formularios, exclusiones y renovaciones.

2. Qué está cambiando realmente en el mercado asegurador

Si el primer bloque fijaba una idea básica —que la IA ya puede activar responsabilidad real—, este bloque aclara la segunda: el mercado asegurador ya está reaccionando. No de forma uniforme, no con la misma intensidad en todos los ramos y no igual en todos los países, pero sí con un patrón reconocible: más delimitación del riesgo, menos ambigüedad y más exigencia para asegurar determinados usos.

Eso se traduce en tres movimientos muy concretos: exclusiones específicas, endosos nuevos y underwriting más exigente. En otras palabras: el sector no está discutiendo si la IA existe o no. Está intentando decidir qué parte del riesgo quiere asumir, bajo qué condiciones y con qué límites.

El cambio relevante no es que “asegurar IA” se haya vuelto imposible. El cambio relevante es que ya no puede darse por supuesto.

2.1. Ya aparecen exclusiones específicas de IA en pólizas clave

En los mercados más avanzados ya se están viendo redacciones específicas de exclusión vinculadas a inteligencia artificial generativa, especialmente en líneas como D&O, E&O y responsabilidad civil general. El patrón importa más que el caso concreto: cuando una póliza empieza a excluir reclamaciones que “surjan de”, “se basen en” o “se relacionen con” el uso de IA, la cobertura deja de ser intuitiva y empieza a depender mucho más del wording exacto.

Este movimiento no es una hipótesis académica. Ya está siendo analizado por firmas especializadas en recovery y cobertura, como puede verse en este análisis de Hunton, que resume la proliferación de exclusiones de IA y la lógica de mercado que las acompaña.

Dónde está el punto delicado

Una exclusión amplia no solo puede dejar fuera un “riesgo tecnológico” en abstracto. También puede afectar a reclamaciones que, sin la presencia de IA, parecerían encajar como daños tradicionales: error profesional, perjuicio económico, publicidad engañosa, difamación o reclamaciones por supervisión deficiente.

2.2. En RC general ya se está intentando acotar la exposición GenAI

Uno de los desarrollos más significativos es que también empieza a moverse la responsabilidad civil general. Verisk (ISO) ha trabajado formularios y endosos orientados a delimitar exposiciones relacionadas con IA generativa, lo que refuerza la idea de que el fenómeno no se limita a pólizas tecnológicas o especializadas.

Si quieres sostener este punto con fuente primaria y un apoyo sectorial, puedes mantener ambos enlaces: Verisk (ISO) y resumen sectorial.

Esto importa porque rompe una simplificación frecuente: pensar que el problema de la IA solo afecta a ciber o a pólizas muy especializadas. No es así. En cuanto el riesgo se conecta con actividad empresarial, comunicación, servicio o producto, la discusión puede abrirse también en pólizas más generales.

2.3. El otro cambio silencioso: renovaciones más duras y más preguntas de underwriting

En muchos casos, la fricción no aparece primero como una exclusión frontal, sino como un proceso de renovación más exigente. Empiezan a pedir más detalle sobre usos reales de IA, supervisión humana, trazabilidad, políticas internas, gestión de proveedores y criticidad de los procesos afectados.

Ese endurecimiento importa tanto como la exclusión expresa. Una empresa que no puede explicar con claridad dónde usa IA, con qué impacto y bajo qué control llega más débil a la conversación aseguradora. Y esa debilidad no solo afecta al precio o a la aceptación del riesgo: también puede influir en cómo se interpreta después un siniestro.

- Inventario real de usos de IA, no solo listado de herramientas.

- Nivel de supervisión humana en procesos con impacto externo o sensible.

- Capacidad de reconstruir inputs, outputs y decisión final.

- Políticas internas y responsables claros.

- Dependencia de proveedores externos y reparto contractual del riesgo.

2.4. El matiz importante: no es un rechazo uniforme a la IA

Aquí conviene no deformar el mensaje. Decir que “las aseguradoras están dejando de cubrir la IA” sería demasiado tosco. El mercado está en transición. Algunas entidades están reaccionando con exclusiones amplias o con mayor cautela. Otras están explorando coberturas afirmativas o productos más acotados para riesgos concretos.

Un ejemplo útil para sostener ese matiz es el de AXA XL, que ha lanzado cobertura específica vinculada a riesgos emergentes de GenAI dentro de su producto ciber. Puedes mantener tanto el comunicado como la ficha de producto.

La lectura correcta, por tanto, no es “el seguro rechaza la IA”. La lectura correcta es otra: el mercado está dejando de tratarla como un riesgo implícito o secundario y empieza a exigir una posición explícita.

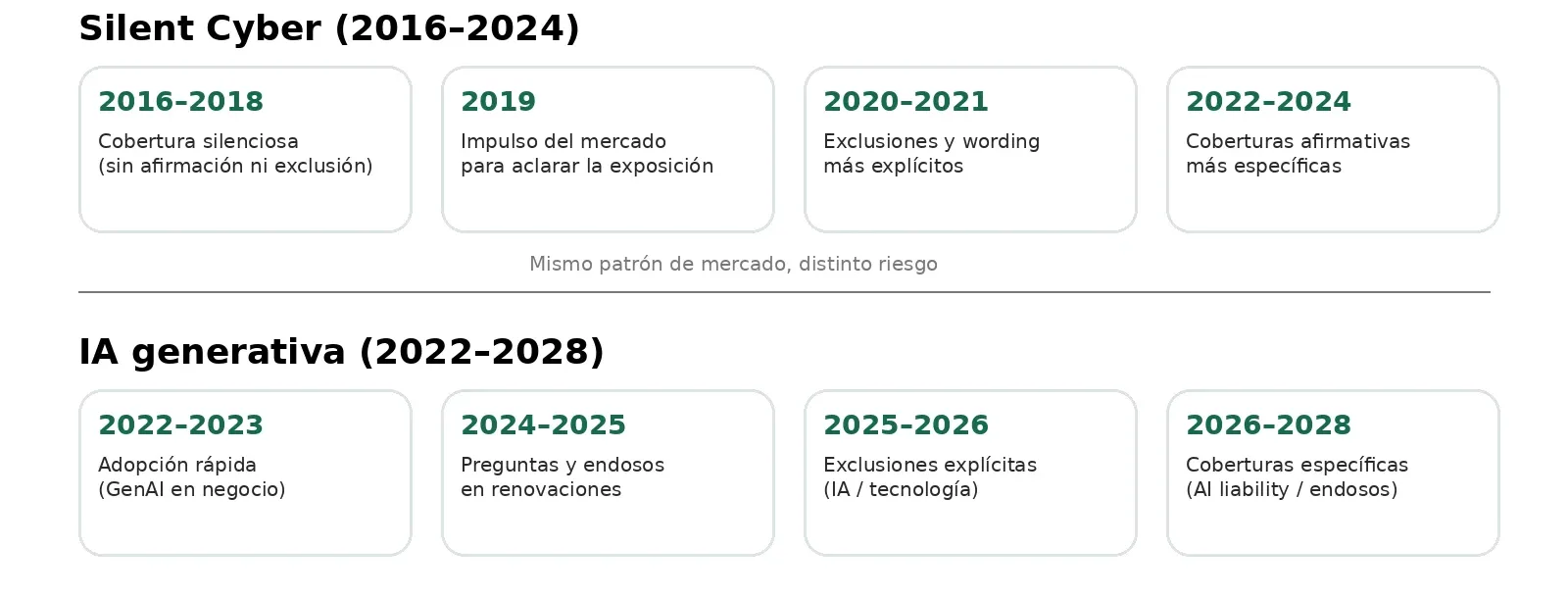

2.5. La analogía útil: por qué se parece cada vez más al patrón de “silent cyber”

La forma más clara de entender lo que está ocurriendo es compararlo con la evolución del silent cyber. Durante años, muchas pólizas tradicionales convivieron con exposición ciber sin afirmar ni excluir con claridad ese riesgo. Cuando el mercado entendió que esa ambigüedad generaba demasiada incertidumbre, empezó a empujar hacia una aclaración más explícita: o se cubre, o se excluye, o se limita.

Con IA empieza a verse una lógica parecida. Primero aparece la ambigüedad. Después llegan exclusiones amplias. Más tarde surgen productos o endosos más afirmativos para usos concretos, normalmente bajo más condiciones y con mayor coste. Si quieres sostener bien este paralelismo, aquí sí merece la pena mantener Marsh y la referencia técnica de la American Academy of Actuaries.

3. El punto crítico: cuándo un uso de IA se convierte en una reclamación real

Hasta aquí hemos fijado dos ideas: la empresa sigue respondiendo cuando la IA participa en un proceso real y el mercado asegurador ya está intentando acotar ese riesgo. El siguiente paso es bajar al terreno donde de verdad importa: los escenarios concretos de reclamación.

El riesgo no aparece porque una empresa tenga acceso a una herramienta de IA. Aparece cuando esa herramienta interviene en un flujo que produce efectos reales: un contenido que se publica, una respuesta que recibe un cliente, una decisión que afecta a una persona, una recomendación que forma parte de un servicio o una automatización que genera un perjuicio económico, reputacional o regulatorio.

La pregunta útil no es si la IA “falló”. La pregunta útil es en qué momento ese fallo sale del sistema y se convierte en un daño defendible por un tercero.

3.1. Cuando el contenido generado deja de ser borrador y pasa a ser acto empresarial

Uno de los errores más comunes es tratar los contenidos generados por IA como si siguieran siendo material interno aunque ya se hayan convertido en comunicación real de empresa. En cuanto un texto, una imagen, una pieza comercial, una respuesta pública o una creativa generada con apoyo de IA se publica, se envía o se utiliza frente a terceros, deja de ser un simple output técnico. Pasa a ser un acto empresarial.

Ahí aparecen riesgos que no son en absoluto exóticos: afirmaciones falsas sobre un competidor, promesas comerciales inexactas, uso problemático de elementos protegidos, descripciones engañosas o mensajes que erosionan derechos de terceros. La IA no crea mágicamente una categoría nueva de daño. Lo que hace es aumentar velocidad, volumen y opacidad en daños que ya existían.

- Un copy generado por IA introduce una afirmación falsa sobre un competidor y la marca la publica sin revisión suficiente.

- Una pieza creativa generada con IA reproduce elementos demasiado cercanos a material protegido y desencadena una reclamación.

- Una campaña automatizada exagera capacidades, condiciones o resultados y abre un frente de publicidad engañosa.

3.2. Chatbots, asistentes y respuestas automáticas: cuando la “ayuda” genera confianza y perjuicio

Otro punto especialmente delicado está en chatbots, asistentes virtuales y flujos automatizados de atención. Muchas empresas los implantan para descargar trabajo operativo o acelerar tiempos de respuesta, pero olvidan que, desde la perspectiva del usuario, la respuesta del sistema se percibe como respuesta de la empresa.

Si el asistente promete una condición que no existe, comunica mal una política, da una información incompleta, induce a una decisión errónea o transmite una certeza que no tenía base suficiente, el daño ya no es técnico. Es comercial, contractual, reputacional o incluso regulatorio, según el caso.

El problema se agrava cuando la empresa presenta ese canal como fiable, inmediato o inteligente y, al mismo tiempo, no establece límites claros, escalado humano o revisión de outputs sensibles. En ese punto, la automatización no solo ahorra tiempo: también puede amplificar exposición.

Dónde suele empezar la discusión de verdad

No en que el chatbot exista, sino en que el usuario razonablemente confíe en la respuesta y la empresa no pueda demostrar ni supervisión adecuada, ni límites operativos claros, ni capacidad de reconstruir qué ocurrió.

3.3. Decisiones automatizadas con impacto económico, reputacional o legal

El riesgo sube un nivel cuando la IA ya no solo genera contenido o respuestas, sino que influye en decisiones: scoring, pricing, priorización comercial, clasificación de leads, evaluación documental, selección de candidatos o asignación de recursos. Aquí la cuestión no es únicamente si el output era correcto, sino si la organización puede justificar cómo se usó, con qué criterio y bajo qué supervisión.

Cuanto más sensible sea el proceso, menos defendible resulta la lógica de “la IA solo ayudaba”. Si el sistema condiciona una decisión con impacto real sobre clientes, empleados, candidatos o terceros, la empresa necesita poder demostrar algo más que buena intención. Necesita poder demostrar gobierno, revisión humana y trazabilidad suficiente.

| Uso de IA | Posible daño | Tipo de exposición | Punto débil habitual |

|---|---|---|---|

| Contenido comercial | Difamación, publicidad engañosa, vulneración de derechos o perjuicio reputacional | RC / contractual / reputacional | Publicación sin revisión suficiente |

| Chatbots y atención automática | Información incorrecta, promesas inexactas, decisiones erróneas del cliente | RC / contractual / servicio | Confianza excesiva en respuestas no supervisadas |

| Scoring, pricing o priorización | Decisiones injustificables, sesgos, perjuicio económico | E&O / D&O / regulatorio | Falta de supervisión y de criterios explicables |

| RR. HH. y selección | Discriminación, exclusión indebida, opacidad en decisiones | Laboral / D&O / cumplimiento | Delegación excesiva en sistemas opacos |

| Informes o recomendaciones | Error profesional, omisión, consejo defectuoso | E&O | Incorporar output de IA al servicio sin control final sólido |

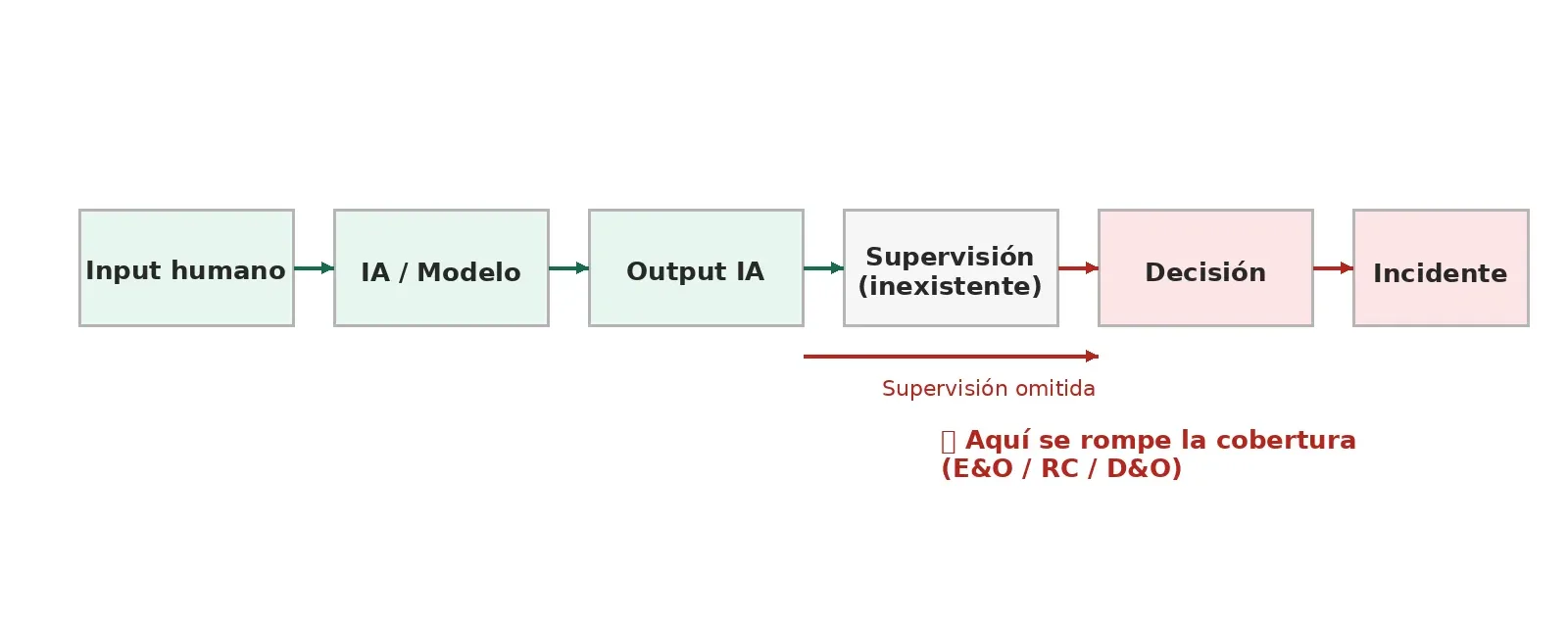

3.4. Alucinaciones, errores plausibles y supervisión humana insuficiente

Aquí conviene ser precisos. El verdadero problema no son solo las llamadas “alucinaciones”. También lo son los errores plausibles: respuestas incorrectas, incompletas o sesgadas que suenan razonables y por eso pasan filtros débiles. En un entorno empresarial, ese tipo de error puede ser incluso más peligroso que uno grotesco, porque llega más lejos antes de detectarse.

Por eso la supervisión humana no puede reducirse a una validación meramente formal. Si la revisión es automática, apresurada o hecha por alguien sin criterio suficiente sobre el contexto, la empresa no está reduciendo realmente el riesgo. Solo está colocando una capa de apariencia de control.

4. Por qué muchas pólizas ya no cubren lo que antes sí

Aquí está uno de los puntos más delicados del artículo. Muchas empresas entienden bien que la IA puede generar errores, reclamaciones o problemas de cumplimiento. Lo que entienden peor es algo más incómodo: el daño puede parecer tradicional y, aun así, la cobertura dejar de serlo cuando la inteligencia artificial aparece en el origen del hecho.

Dicho de otra forma: un perjuicio económico, una reclamación por difamación, una infracción de derechos o un error profesional pueden seguir teniendo una apariencia conocida. Lo que cambia es el encaje. Si la póliza incorpora una exclusión específica de IA, una exclusión tecnológica amplia o una redacción lo bastante abierta, el asegurador puede discutir que ese siniestro ya no entra donde antes parecía entrar sin demasiada controversia.

El riesgo real no siempre está en un daño nuevo. A veces está en que un daño viejo deja de estar cubierto como se asumía.

4.1. El punto crítico: exclusiones amplias que cambian por completo la lectura del siniestro

Este cambio se vuelve especialmente relevante cuando la exclusión no está redactada de forma estrecha, sino con fórmulas amplias del tipo “que surja de”, “se base en” o “se relacione con” el uso, desarrollo, despliegue o dependencia de sistemas de IA. Ese tipo de wording da mucho más margen para discutir cobertura, porque no exige que la IA sea el daño en sí mismo. Puede bastar con que esté suficientemente conectada al hecho que origina la reclamación.

Por eso una exclusión amplia no afecta solo a “riesgos de IA” en abstracto. Puede afectar también a reclamaciones que, vistas desde fuera, se parecen a daños clásicos de actividad empresarial: una campaña que induce a error, una recomendación profesional defectuosa, una respuesta automatizada que genera confianza indebida o una decisión mal supervisada con impacto económico en un tercero.

Dónde se suele equivocar la empresa

En pensar que, como el daño no parece “tecnológico”, la póliza responderá igual que antes. El problema es que la controversia ya no gira solo sobre el tipo de daño, sino sobre si la presencia de IA desplaza ese hecho fuera del perímetro de cobertura.

4.2. El problema del “silent AI”: no saber si estás cubierto también es riesgo

El segundo gran problema no siempre es una exclusión expresa. A veces es justo lo contrario: la ausencia de definición clara. En muchas pólizas la IA todavía no aparece ni como cobertura afirmativa ni como exclusión frontal. Eso genera una situación que cada vez se entiende mejor con una lógica similar al antiguo silent cyber: el riesgo existe, el mercado sabe que existe, pero el wording todavía no lo ha resuelto con claridad.

Ese “silent AI” no da tranquilidad. Da incertidumbre. La empresa asume que está cubierta porque no ve una exclusión explícita, pero en caso de siniestro puede encontrarse con una discusión de interpretación precisamente en el peor momento: cuando el daño ya se ha producido y la cobertura deja de ser una presunción para convertirse en una disputa.

Desde gestión del riesgo, eso ya es un problema en sí mismo. No solo importa quedar cubierto. También importa poder saber con un grado razonable de certeza qué está cubierto, qué no y bajo qué condiciones.

- No menciona IA, modelos, algoritmos o decisiones automatizadas en ningún punto relevante.

- Tampoco aclara si errores del servicio siguen cubiertos cuando interviene IA en el output final.

- Usa definiciones tecnológicas genéricas que podrían estirarse en un siniestro complejo.

- No diferencia entre uso auxiliar, uso operativo y uso que afecta decisiones sensibles.

4.3. RC, E&O, D&O y ciber: no juegan el mismo partido

Otro error frecuente es hablar de “el seguro” como si fuera una sola capa homogénea. No lo es. Cada línea juega un papel distinto y, precisamente por eso, la entrada de la IA no afecta a todas igual. El daño puede parecer el mismo a ojos de la empresa, pero desde el punto de vista de cobertura la discusión puede abrirse en lugares muy diferentes.

| Línea de seguro | Qué suele cubrir | Dónde se tensiona con IA | Qué conviene revisar |

|---|---|---|---|

| RC general | Daños a terceros derivados de actividad, producto, comunicación o determinados perjuicios publicitarios, según póliza. | Contenidos generados, claims por publicidad, respuestas automáticas o daños conectados a productos/servicios donde interviene IA. | Exclusiones específicas de GenAI, wording amplio y referencias a tecnología, automatización o contenidos generados. |

| E&O / RC profesional | Errores y omisiones en la prestación de un servicio profesional. | Informes, análisis, propuestas, recomendaciones o documentación donde la IA forma parte del output entregado al cliente. | Si el servicio sigue cubierto cuando la IA participa materialmente en el resultado final. |

| D&O | Reclamaciones por actos de administración, supervisión y gobierno. | Fallo de oversight, ausencia de políticas, permisividad ante un riesgo ya conocido o controles claramente insuficientes. | Preguntas de underwriting, exclusiones ligadas a IA y exigencia de demostrar gobierno razonable. |

| Ciber | Incidentes de seguridad, brechas, ransomware y respuesta a incidentes, según póliza. | La IA puede estar implicada, pero no todo daño derivado de su uso encaja realmente en una lógica ciber. | Qué daños siguen siendo un evento ciber y cuáles se desplazan a otras líneas o a cobertura no afirmativa. |

Esta diferencia importa mucho. Una misma empresa puede tener una exposición difusa si mira el riesgo “por tecnología”, cuando en realidad debería mirarlo “por tipo de daño y por línea potencial de cobertura”. Ese cambio de enfoque es el que permite revisar pólizas con criterio y no con una lista genérica de términos de moda.

4.4. Cuando la cobertura se desplaza: del seguro al contrato o al balance de la empresa

Cuando una póliza se vuelve más restrictiva o más ambigua, el riesgo no desaparece. Se desplaza. A veces se desplaza al contrato con el proveedor tecnológico. Otras veces al contrato con el cliente. Y muchas veces termina, en última instancia, en el propio balance de la empresa si nadie había cerrado antes ese reparto de responsabilidad.

Este punto es especialmente importante en organizaciones que dependen de herramientas SaaS, modelos de terceros, copilots integrados o cadenas largas de proveedor. Cuanto más externo es el stack, más fácil es asumir que el problema “ya estará cubierto” por otro. Pero ni el proveedor va a absorber automáticamente tu exposición, ni tu cliente va a aceptar sin más que el daño lo causó una herramienta externa.

Traducción a negocio

Si la cobertura se estrecha, la conversación deja de ser solo aseguradora y pasa a ser también contractual. Límites de responsabilidad, indemnidades, garantías, seguros exigibles y reparto de riesgo con proveedores dejan de ser cláusulas secundarias.

4.5. Qué merece una revisión inmediata en el wording

En la práctica, la revisión útil no consiste en leer la póliza “entera” de nuevo con miedo difuso a la IA. Consiste en ir a los puntos donde de verdad puede romperse el encaje. Ahí es donde una dirección, junto con su corredor, asesoría o aseguradora, debería detenerse con más rigor.

- Definiciones: si aparecen IA, algoritmos, sistemas automatizados, contenido generado o errores tecnológicos.

- Grant de cobertura: si el tipo de siniestro típico de tu actividad sigue encajando cuando interviene IA.

- Exclusiones y endosos: si existe wording específico o lenguaje suficientemente amplio para desplazar el riesgo.

- Condiciones de renovación: si underwriting ya está exigiendo más detalle del que antes pedía.

- Interacción entre pólizas: qué queda realmente en RC, qué en E&O, qué en D&O y qué nunca fue ciber aunque se pareciera.

En este punto, el artículo ya no está hablando solo de seguros. Está hablando de una idea más amplia y más relevante para dirección: dejar de operar con supuestos heredados. Porque muchas empresas siguen usando IA con un mapa de cobertura pensado para un modelo operativo anterior.

5. ¿Puede haber responsabilidad penal por el uso de IA?

Este es uno de los puntos donde más fácilmente se exagera o se banaliza. La formulación correcta es más sobria: usar IA en la empresa no genera por sí mismo responsabilidad penal, pero tampoco actúa como escudo si ese uso se integra en procesos sensibles sin controles razonables y termina produciendo un daño relevante.

La IA no elimina la posible responsabilidad de quienes diseñan, autorizan, supervisan o permiten que un sistema opere con impacto real sobre clientes, empleados, terceros o decisiones relevantes del negocio.

El riesgo penal no nace de “usar IA”. Nace, en su caso, de usarla sin control allí donde ese control era exigible.

5.1. Lo que no conviene afirmar: que la IA genera un riesgo penal automático

No es correcto trasladar la idea de que implantar IA abre por defecto una vía penal. La mayoría de usos empresariales no van a activar por sí solos ese escenario. Lo que sí puede aumentar es la exposición cuando la empresa delega de forma imprudente en sistemas automatizados dentro de procesos con consecuencias reales.

- Usar IA como apoyo operativo con supervisión humana real.

- Un error aislado detectado, corregido y gestionado con diligencia.

- Automatizaciones de bajo impacto sin efectos relevantes sobre terceros.

- Procesos donde la IA asiste, pero no desplaza el control efectivo de personas responsables.

5.2. Dónde sí se complica: negligencia grave, opacidad y ausencia de control

El problema aparece cuando la empresa integra IA en procesos sensibles y, aun así, no establece un nivel de control mínimamente defendible. Ahí la discusión deja de ser tecnológica y pasa a ser de conducta empresarial: previsibilidad del riesgo, diligencia desplegada y estructura real de supervisión.

Si una organización permite que sistemas automatizados operen con impacto relevante sin responsables claros, sin límites, sin revisión material y sin capacidad de reconstruir qué ocurrió, el uso de IA deja de parecer una simple ayuda operativa. En ese punto, la exposición aumenta de forma seria.

La clave no es la IA. Es la falta de gobierno.

En un escenario problemático, la cuestión rara vez será “había inteligencia artificial”. La cuestión será si la organización permitió que una herramienta con impacto real funcionara sin controles razonables, sin supervisión efectiva y sin trazabilidad suficiente.

5.3. El papel del órgano de administración

Cuando la IA entra en procesos relevantes del negocio, deja de ser un asunto puramente técnico o delegable sin más. Pasa a formar parte del perímetro de supervisión que la empresa debe poder justificar si después surge una reclamación, una investigación o un incidente serio.

Eso no significa que el órgano de administración tenga que entender cada detalle técnico del modelo. Sí significa que debe asegurarse de que existen políticas, límites, responsables, escalado y revisión humana proporcionales al impacto del uso.

5.4. Donde el control humano deja de ser un formalismo

Hay un terreno especialmente sensible: las decisiones automatizadas que producen efectos jurídicos o afectan de forma significativa a una persona. Ahí la empresa necesita poder explicar algo más que “el sistema ayudó”. Necesita justificar qué intervención humana existía realmente, qué peso tuvo el sistema y con qué garantías se utilizó.

- Procesos con efectos significativos sobre personas y revisión humana puramente formal.

- Decisiones sensibles donde nadie puede explicar criterios, límites o pesos del sistema.

- Delegación práctica en proveedores o herramientas externas sin control interno suficiente.

- Uso continuado de IA en ámbitos críticos pese a señales previas de error o funcionamiento deficiente.

La conclusión correcta no es alarmista, pero tampoco ingenua: la IA no genera responsabilidad penal por defecto, pero tampoco neutraliza la responsabilidad cuando una empresa la integra en procesos sensibles sin supervisión real y sin capacidad de demostrar control suficiente.

6. El verdadero problema no es la IA: es la falta de gobierno y trazabilidad

Si el bloque anterior servía para corregir una idea simplista —que la IA genera por sí misma un problema penal—, este sirve para fijar la tesis de fondo del artículo: en la mayoría de empresas el riesgo real no está en la tecnología, sino en la forma desordenada en que entra en el negocio.

La IA no suele implantarse de golpe mediante un gran proyecto perfectamente gobernado. En muchas organizaciones entra por herramientas concretas, por iniciativas de equipos, por automatizaciones parciales o por decisiones tácticas que funcionan lo bastante bien como para consolidarse antes de que exista una política clara. Y ahí aparece el problema: la empresa normaliza el uso antes de haber decidido quién responde, qué se puede hacer, qué no, dónde hay que supervisar y qué evidencias deben conservarse.

La mayoría de compañías no tienen un problema de “exceso de IA”. Tienen un problema de uso real sin mapa, sin responsables y sin trazabilidad suficiente.

6.1. El patrón más frecuente: la IA entra por la vía operativa y el gobierno llega tarde

Este es probablemente el patrón más habitual en pymes, mid-market e incluso en organizaciones más grandes: primero se adopta la herramienta porque ahorra tiempo, acelera una tarea o desbloquea una necesidad concreta. Después distintos equipos la incorporan a sus rutinas. Y solo más tarde, cuando el uso ya se ha extendido, alguien se da cuenta de que no existe una foto fiable de dónde interviene la IA, con qué criticidad y bajo qué control.

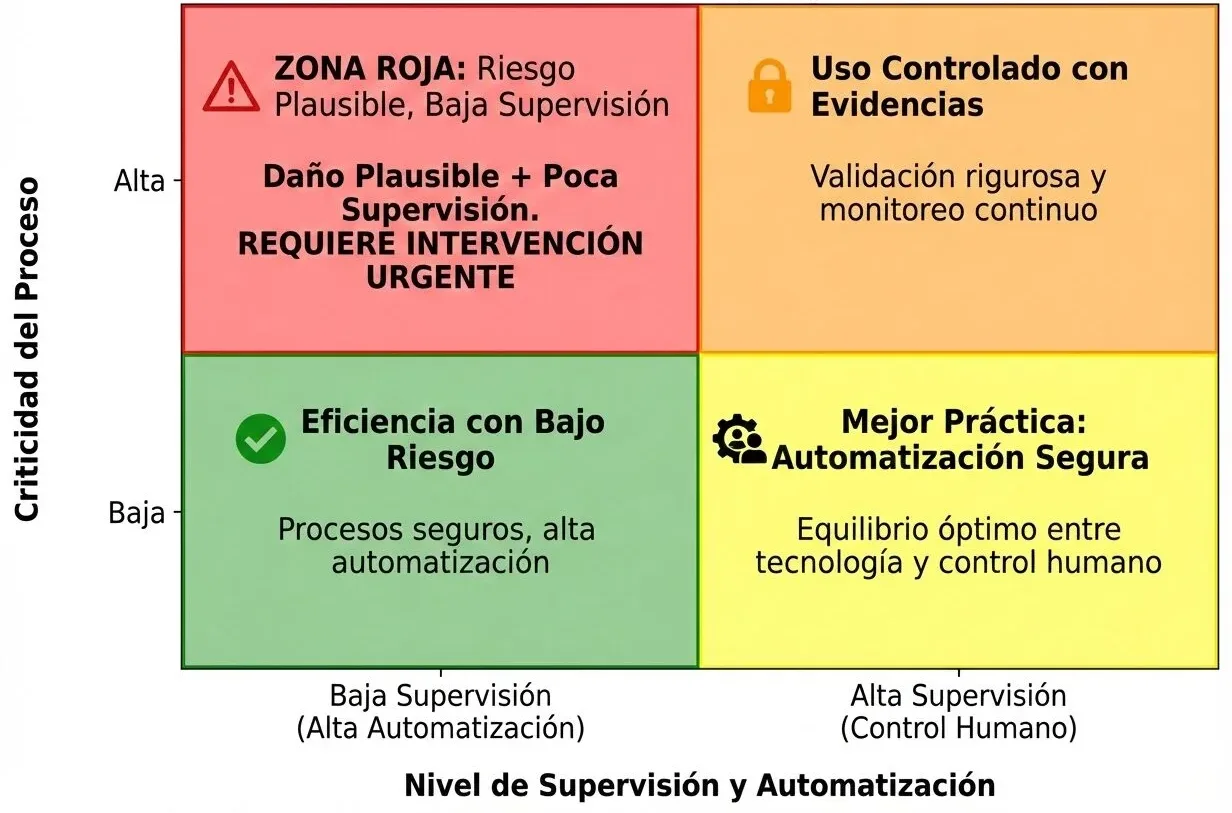

Ese desfase importa mucho. Sin inventario real de usos no hay priorización. Sin priorización no hay reglas proporcionales. Y sin reglas proporcionales, la empresa no sabe distinguir entre un uso de apoyo relativamente inocuo y un uso que ya influye en decisiones sensibles, comunicaciones externas o procesos con impacto sobre terceros.

El riesgo no crece solo por sofisticación técnica

A menudo crece por normalización desordenada. La herramienta funciona, el equipo gana velocidad y el uso se expande antes de que exista una estructura mínima de control. Cuando eso ocurre, la exposición aumenta sin que la empresa lo haya decidido conscientemente.

6.2. Sin inventario, la organización no sabe realmente dónde se está jugando el riesgo

Muchas compañías creen que “usan IA” en un sentido muy general, pero no podrían responder con precisión a preguntas bastante básicas: en qué áreas interviene, qué procesos dependen ya de outputs generados, qué usos se publican o se entregan a clientes, dónde influye en decisiones y en qué flujos existe supervisión humana real. Esa falta de visibilidad no es un detalle operativo. Es una debilidad de gobierno.

Inventariar no significa burocratizar cada experimento menor. Significa, simplemente, poder distinguir entre usos de baja criticidad y usos donde el margen de error, el daño potencial o la sensibilidad del proceso exigen un control más serio. Si la empresa no tiene esa foto, tampoco puede defender con credibilidad que está gestionando el riesgo de forma razonable.

- ¿En qué procesos interviene ya la IA de forma habitual?

- ¿Qué usos llegan a clientes, mercado, candidatos, empleados o terceros?

- ¿Qué flujos influyen en decisiones económicas, comerciales o de personas?

- ¿Dónde existe revisión humana real y dónde solo una validación formal?

- ¿Qué proveedores, herramientas o modelos externos están dentro del circuito?

6.3. La trazabilidad no es burocracia: es capacidad de defensa

Este es uno de los puntos más mal entendidos. Cuando se habla de trazabilidad, algunas empresas lo perciben como una exigencia pesada o excesivamente formalista. Pero en realidad la lógica es bastante más simple: si hay una reclamación, una investigación o un incidente, la organización necesita poder reconstruir qué ocurrió.

Eso significa poder responder, con un nivel razonable de evidencia, a preguntas como estas: qué se pidió al sistema, qué devolvió, quién lo revisó, qué se decidió finalmente, qué parte del output se modificó, qué proveedor o modelo estaba detrás y con qué criterio se autorizó su uso en ese contexto. Si la empresa no puede reconstruir la secuencia, su posición se debilita en todos los frentes a la vez: jurídico, asegurador, contractual y reputacional.

Por eso la trazabilidad no debe plantearse como obsesión documental indiscriminada. Debe plantearse como una práctica proporcional: más exigencia donde el impacto es mayor, menos fricción donde el uso es claramente auxiliar y de bajo riesgo.

6.4. El AI Act refuerza una dirección clara: supervisión, registros y medidas organizativas

Aquí conviene ser precisos otra vez. No toda empresa que usa IA cae automáticamente dentro de los supuestos más exigentes del AI Act, ni todos los usos corporativos son “alto riesgo” en el sentido técnico del reglamento. Pero el texto sí consolida una dirección muy clara: cuando un sistema de IA afecta de forma relevante a derechos, decisiones o seguridad, ya no basta con hablar de innovación. Hay que hablar también de supervisión humana, documentación, responsabilidades y medidas organizativas.

Eso importa incluso para organizaciones cuyos usos no encajan de lleno en las categorías más sensibles del reglamento. Porque el AI Act no solo introduce obligaciones concretas para ciertos supuestos; también eleva el estándar cultural de lo que se considera un uso serio y defendible de la IA en entorno empresarial.

Si quieres mantener la referencia oficial, aquí sí tiene sentido enlazar al texto oficial del Reglamento (UE) 2024/1689 en EUR-Lex y, si prefieres versión PDF, a la versión publicada en DOUE/BOE.

6.5. Lo que una empresa madura debería tener, aunque no esté en un caso de “alto riesgo”

La lectura útil para dirección no es esperar a ver si una autoridad, una aseguradora o un litigio obliga a ordenar el tema. La lectura útil es más sencilla: si la IA ya está entrando en procesos reales, hace falta una estructura mínima de gobierno antes de que el uso siga escalando por inercia.

Quién autoriza usos, quién supervisa, quién decide y quién responde en procesos donde la IA influye materialmente.

No todos los usos requieren el mismo nivel de control. Lo serio es distinguir dónde basta una revisión ligera y dónde hace falta supervisión reforzada.

No registrar todo, pero sí conservar la trazabilidad mínima en los flujos donde un error puede generar daño real o discusión de cobertura.

Esta lógica enlaza, además, con algo que en Rumbo & Resultados ya defendemos en otros activos: antes de escalar IA, conviene ordenar criterio, usos y prioridades. Si quieres cruzar esta pieza con un enfoque más operativo, aquí sí tiene sentido enlazar con el checklist de IA práctica, con Dónde la IA sí ahorra tiempo (y dónde no) y con el servicio de Integración de IA para pymes y startups.

7. Qué debería revisar hoy una empresa sensata

Si hablamos de IA y seguros en la empresa, el punto práctico no es debatir más sobre tecnología, sino revisar dónde ya existe exposición real.

A estas alturas, la conclusión práctica debería ser clara: si la IA ya participa en procesos reales, la empresa necesita dejar de operar por inercia. No hace falta una gran arquitectura teórica. Hace falta una revisión ejecutiva ordenada.

El objetivo no es frenar la IA. El objetivo es dejar de asumir riesgos que nadie ha decidido conscientemente.

7.1. Primer frente: mapa real de usos

El punto de partida no es preguntar si la empresa “usa IA”. Eso ya no dice casi nada. Lo útil es identificar dónde interviene, en qué procesos, con qué impacto y con qué nivel de supervisión.

- Qué áreas usan IA de forma habitual y no puntual.

- Qué outputs llegan a clientes, mercado, candidatos, empleados o terceros.

- Qué procesos dependen ya de análisis, respuestas o recomendaciones generadas por IA.

- Qué usos son de apoyo y cuáles ya son materialmente sensibles.

7.2. Segundo frente: revisión de pólizas

Con ese mapa en la mano, toca revisar el programa de seguros con lógica de exposición: RC general, E&O, D&O y ciber, además de cualquier cobertura específica que aplique a tu actividad.

| Bloque de revisión | Qué mirar | Pregunta ejecutiva |

|---|---|---|

| Definiciones | IA, algoritmos, automatización, contenido generado, errores tecnológicos, decisiones automatizadas. | ¿La póliza nombra este riesgo o lo deja en zona gris? |

| Grant de cobertura | Qué daños o errores siguen cubiertos cuando interviene IA en el proceso o en el output final. | ¿Mi siniestro típico sigue encajando hoy? |

| Exclusiones y endosos | Lenguaje amplio, exclusiones tecnológicas, exclusiones específicas de IA, limitaciones nuevas. | ¿El riesgo queda cubierto, limitado o desplazado? |

| Renovación y underwriting | Nuevos cuestionarios, detalle sobre usos, supervisión, proveedores y trazabilidad. | ¿Puedo responder con evidencia y no con generalidades? |

7.3. Tercer frente: contratos y proveedores

Si la cobertura se estrecha o se vuelve incierta, parte del riesgo se desplaza al contrato. Por eso conviene revisar la posición de la empresa frente a proveedores tecnológicos, SaaS, modelos externos y clientes.

Error típico de empresa

Asumir que, porque la herramienta es externa, el proveedor absorberá el riesgo principal. En la práctica, muchas veces limita mucho su responsabilidad y la exposición sigue quedándose en quien usa el sistema frente al cliente o frente al mercado.

7.4. Cuarto frente: supervisión y trazabilidad mínima

No basta con declarar que existe revisión humana. Hace falta distinguir entre una validación simbólica y un control material. En procesos de alta criticidad, la empresa debe poder demostrar quién revisa, qué revisa y con qué capacidad real para corregir o bloquear un output antes de que produzca un efecto relevante.

Usos de apoyo interno o productividad personal donde el output no llega directamente a terceros ni condiciona decisiones sensibles.

Usos que aceleran trabajo operativo o comercial, pero donde una revisión competente antes de publicar, enviar o ejecutar sigue siendo suficiente.

Procesos que afectan a clientes, mercado, personas, condiciones económicas, recomendaciones profesionales o decisiones con impacto jurídico o reputacional.

- Qué función cumplía el sistema en ese flujo.

- Qué output produjo y qué parte se utilizó realmente.

- Quién revisó, validó o modificó el resultado.

- Qué decisión final se tomó y con qué criterio.

- Qué proveedor, herramienta o modelo estaba detrás.

7.5. El siguiente paso razonable

Si todavía estás en una fase donde los usos crecen de forma dispersa, conviene ordenar primero criterio y prioridades. En ese punto tiene sentido enlazar esta pieza con el checklist de IA práctica, con Dónde la IA sí ahorra tiempo (y dónde no) y con el servicio de Integración de IA para pymes y startups.

Antes de seguir escalando la IA, conviene ordenar dónde entra, qué riesgo abre y bajo qué reglas debe operar.

Muchas empresas no tienen un problema de acceso a herramientas. Tienen un problema de criterio, gobierno y control sobre usos que ya están dentro del negocio.

Si la IA ya participa en contenidos, atención, análisis, decisiones o procesos sensibles, el siguiente paso no es añadir más automatización por inercia. Es revisar con claridad qué se está haciendo, qué impacto tiene y qué riesgos se están asumiendo sin haberlos decidido bien.

8. Preguntas frecuentes sobre IA y seguros en la empresa

Respuestas directas a las dudas más habituales cuando una empresa ya está usando IA o está a punto de integrarla en procesos con impacto real.

¿Usar IA en la empresa puede dejarme sin cobertura?

Puede abrir una laguna de cobertura, sí, pero no porque toda IA quede automáticamente fuera. El problema aparece cuando una reclamación conecta con un uso de IA y la póliza incorpora una exclusión expresa, una redacción suficientemente amplia o un silencio que deja el encaje en zona gris. El error habitual es asumir que, porque el daño parece “tradicional”, la cobertura seguirá funcionando igual.

¿Esto afecta solo a grandes empresas o también a pymes?

También afecta a pymes, y muchas veces más de lo que parece. No porque tengan más riesgo por tamaño, sino porque suelen adoptar herramientas útiles más deprisa que su capacidad para gobernarlas. Si una pyme usa IA en contenidos, atención automática, pricing, selección o propuestas comerciales sin revisar pólizas, contratos y controles, su exposición existe igual.

¿El ciberseguro cubre los problemas derivados del uso de IA?

No necesariamente. El ciberseguro puede responder bien ante brechas, incidentes de seguridad o ransomware aunque haya IA en el entorno. Pero muchos daños derivados del uso empresarial de IA no son, en esencia, un siniestro ciber. Pueden ser un problema de responsabilidad civil, de responsabilidad profesional, de supervisión directiva o incluso contractual.

¿Quién responde cuando un sistema de IA toma una mala decisión?

Responde la empresa que decidió usarlo dentro de un proceso real. La IA no es un sujeto responsable. Por eso, cuando un output automatizado genera un perjuicio, la discusión no se centra en la herramienta como si actuara sola, sino en quién la integró, qué supervisión existía y si el uso era razonable en ese contexto.

¿La responsabilidad penal aparece automáticamente por usar IA?

No. Usar IA no genera por sí mismo responsabilidad penal. El riesgo aparece cuando la empresa la integra en procesos sensibles sin control real, sin responsables claros y sin medidas proporcionadas, y esa falta de gobierno termina produciendo un daño relevante. La IA no crea un problema penal por defecto, pero tampoco funciona como escudo frente a negligencia grave o ausencia de supervisión exigible.

¿Qué es el “silent AI” y por qué debería importarme?

Es una forma útil de describir una situación incómoda: la póliza no menciona con claridad la IA ni para cubrirla ni para excluirla. Eso puede parecer tranquilizador, pero en realidad crea incertidumbre. Si hay siniestro, la cobertura deja de ser una presunción cómoda y pasa a depender de interpretación. Y cuando la discusión llega en ese momento, ya llegas tarde.

¿Qué debería revisar una empresa esta misma semana?

Cuatro cosas: dónde usa IA de verdad, qué procesos tienen más criticidad, qué pólizas podrían verse afectadas y qué control puede demostrar hoy. Si además depende de proveedores externos, conviene revisar también límites de responsabilidad, garantías, indemnidades y seguros exigibles. El problema no suele estar en no tener una política perfecta. Suele estar en no tener ni siquiera una foto real del uso actual.

¿La solución prudente es dejar de usar IA?

No. La respuesta seria no es renunciar a la IA, sino dejar de usarla por inercia. Lo razonable es ordenar antes de escalar: distinguir usos de apoyo y usos sensibles, definir supervisión proporcional, revisar cobertura y fijar trazabilidad mínima donde el impacto lo exige. El problema no es la herramienta. El problema es asumir riesgo sin haberlo decidido bien.

¿Tiene sentido revisar esto aunque todavía no hayamos tenido ningún incidente?

Sí, y precisamente por eso. Cuando la revisión llega solo después de una reclamación, una renovación complicada o una incidencia seria, la empresa ya está reaccionando tarde. Este es uno de esos temas donde el valor está en ordenar antes de que el problema te obligue a hacerlo con prisas, tensión contractual y discusión de cobertura encima de la mesa.

¿Te avisamos cuando publiquemos nuevos contenidos?

Nos tomamos en serio tu tiempo. Solo te enviaremos artículos, guías o herramientas que te ayuden a mejorar, decidir o actuar mejor.

Nuestros recursos prácticos y herramientas on-line

Checklist comunicación ciudadana en medio ambiente

Comprueba en minutos si tu municipio comunica de forma eficaz sus iniciativas ambientales y logra implicar

Checklist dirección de proyectos de infraestructura verde

Evalúa si tu municipio cuenta con la capacidad necesaria para dirigir y coordinar proyectos de infraestructura

Checklist modelos operativos del verde urbano

Identifica en pocos minutos si tu municipio cuenta con un modelo operativo sólido para la gestión

Checklist estrategia de infraestructura verde y azul

Evalúa en 2 minutos si tu municipio cuenta con la base necesaria para avanzar en infraestructura