El manager de agentes de IA: qué es, qué función cumple y por qué será clave en empresas, startups y pymes

La IA no elimina la función directiva. La desplaza: de coordinar personas a gobernar sistemas híbridos de agentes, procesos, datos y decisiones.

Publicado 6 de mayo de 2026 · Pymes industriales · Dirección externa · Estrategia dual-use

Durante años, una parte decisiva de la ventaja empresarial ha estado en la calidad del management: saber dirigir equipos, ordenar prioridades, asignar recursos, resolver bloqueos y convertir capacidad en resultados. Esa función no desaparece con la inteligencia artificial. Cambia de terreno.

El cambio no es que los directivos tengan que aprender otra herramienta. El cambio es más profundo: una parte creciente del trabajo empieza a ser ejecutada por sistemas no humanos capaces de investigar, analizar, clasificar, redactar, programar, diseñar, preparar escenarios, activar flujos o asistir decisiones.

Cuando eso ocurre, la empresa ya no puede tratar la IA como una suma de utilidades individuales. Si los agentes producen trabajo real, alguien debe decidir qué hacen, con qué datos trabajan, qué límites tienen, qué outputs pueden generar, quién los valida y qué decisiones pueden o no pueden condicionar.

Este artículo no trata sobre aprender prompts, comprar software o seguir la última tendencia tecnológica. Trata sobre una nueva competencia directiva: gobernar sistemas híbridos de personas, agentes, herramientas, procesos, datos y responsabilidades.

La capacidad técnica habilita. Pero el valor aparece cuando alguien con criterio de negocio decide dónde aplicarla, qué limitar, qué validar y qué no automatizar. Por eso la gestión de agentes de IA no debería quedar reducida a IT, automatización o productividad personal. Es una cuestión de dirección.

- Gestionar agentes de IA será una nueva competencia directiva. No sustituye por completo al management tradicional, pero amplía su perímetro: de coordinar personas a gobernar sistemas híbridos de trabajo.

- El problema no será solo tecnológico. La dificultad real estará en decidir qué trabajo delegar, qué no delegar, quién valida, qué riesgos aparecen y cómo se mide el valor generado.

- Un agente no es un empleado, pero tampoco una herramienta pasiva. Puede producir outputs, interactuar con sistemas y afectar a clientes, costes, procesos, reputación o decisiones.

- La calidad del management volverá a marcar diferencias. Igual que un mal manager desordena equipos humanos, una mala gestión de agentes puede multiplicar producción sin generar valor real.

- Rumbo & Resultados trabaja ya bajo una lógica de dirección aumentada. Los agentes aceleran investigación, análisis, contenidos, herramientas y materiales, pero el rumbo, la priorización y la validación siguen siendo humanos.

- Si eres CEO, fundador o director general: úsalo para entender por qué la IA ya no debe tratarse solo como productividad, sino como una nueva capa de organización del trabajo.

- Si diriges una pyme, startup o scaleup: úsalo para valorar cómo aumentar capacidad sin inflar estructura, pero sin convertir la IA en una suma de automatizaciones dispersas.

- Si lideras tecnología, operaciones, marketing, ventas, datos o atención al cliente: úsalo para distinguir entre implantar herramientas y rediseñar procesos con agentes bajo control humano.

Article

- Qué es un manager de agentes de IA

- Por qué esta función empieza a ser relevante ahora

- Del manager tradicional al manager de agentes

- Qué puede asumir un agente hoy y qué debe seguir validando una persona

- Dirección aumentada en la práctica: el caso de Rumbo & Resultados

- El riesgo de implantar agentes sin gobierno

- Modelo R&R para dirigir agentes de IA en empresa

- Dónde encaja esta función en el organigrama

- Cómo empezar en una pyme, startup o empresa sin crear caos

- La nueva competencia directiva: no tener agentes, sino saber dirigirlos

- Preguntas frecuentes sobre manager de agentes de IA

1. Qué es un manager de agentes de IA

Un manager de agentes de IA es la persona o función responsable de convertir agentes, herramientas, datos y automatizaciones en un sistema de trabajo dirigido. No se limita a usar IA, ni a configurar herramientas, ni a automatizar tareas aisladas.

Su función es más exigente: decidir qué trabajo puede delegarse en agentes, bajo qué límites, con qué información, con qué entregable esperado, quién valida el resultado y cómo se conecta ese output con una decisión, una acción o una mejora operativa real.

1.1. No es un prompt engineer ni un perfil técnico más

Saber formular buenas instrucciones a un modelo de IA puede ser útil, pero no define esta función. El prompt es una herramienta. La gestión de agentes es una responsabilidad de dirección.

La diferencia está en el nivel de decisión. Un usuario avanzado puede mejorar una tarea concreta. Un prompt engineer puede optimizar la interacción con un modelo. Un manager de agentes debe entender qué proceso empresarial se quiere mejorar, qué parte del trabajo puede delegarse, qué riesgo aparece y qué validación humana debe mantenerse.

Lectura limitada

- Formar al equipo solo en prompts.

- Comprar herramientas sin rediseñar procesos.

- Automatizar tareas visibles sin medir impacto.

- Dejar que cada área pruebe IA por separado.

Lectura directiva

- Identificar procesos donde la IA puede aportar capacidad real.

- Separar tareas delegables, asistidas y no delegables.

- Definir responsables humanos y criterios de validación.

- Medir si los agentes mejoran tiempo, calidad, coste o fricción.

1.2. Qué gestiona realmente un manager de agentes

Un agente puede producir un análisis, una respuesta, una clasificación, un borrador, un informe, una propuesta o una acción dentro de un flujo. Pero no entiende por sí mismo la estrategia de la empresa, la sensibilidad comercial, el coste de un error, el contexto del cliente ni la responsabilidad que hay detrás de cada decisión.

Por eso el manager de agentes actúa como una capa de dirección operativa. No sustituye al CEO, a IT, a legal, a operaciones o a los responsables de negocio. Coordina la relación entre esas capas para que los agentes no trabajen como piezas sueltas, sino como parte de un sistema controlado.

| Elemento que gestiona | Què significa a la pràctica | Riesgo si no se gestiona |

|---|---|---|

| Trabajo | Qué proceso, tarea o flujo tiene sentido rediseñar con agentes. | Automatizar actividad sin mejorar el negocio. |

| Dades | Qué información puede usar el agente, con qué calidad y bajo qué restricciones. | Outputs basados en datos incompletos, sensibles o inadecuados. |

| Límites | Qué puede hacer el agente, qué no puede hacer y cuándo debe escalar a una persona. | Conceder autonomía antes de que exista control suficiente. |

| Output | Qué debe entregar el agente y en qué formato: análisis, borrador, alerta, informe, clasificación o acción. | Generar material difícil de usar, revisar o convertir en decisión. |

| Validación | Quién revisa el resultado, con qué criterio y antes de qué uso. | Usar outputs sin responsable claro. |

| Valor | Cómo se mide si el agente mejora tiempo, coste, calidad, velocidad o reducción de fricción. | Confundir producción visible con impacto real. |

La IA aporta capacidad. El management decide si esa capacidad se convierte en trabajo útil, riesgo controlado o simple producción adicional.

1.3. Qué decide y qué no debería decidir

El manager de agentes no debe convertirse en propietario absoluto de la IA dentro de la empresa. Su papel no es decidir la estrategia general, asumir riesgos legales en solitario ni sustituir a los responsables funcionales. Su papel es ordenar el sistema para que la IA se use con intención, límites y responsabilidad.

En la práctica, puede proponer qué procesos son candidatos, qué tareas pueden delegarse, qué controles hacen falta y qué métricas deben seguirse. Pero las decisiones estratégicas, financieras, legales, comerciales o reputacionales deben seguir perteneciendo a la dirección o al responsable correspondiente.

| Puede decidir o proponer | No debería asumir en solitario |

|---|---|

| Qué procesos pueden rediseñarse con agentes. | La estrategia general de la empresa. |

| Qué tareas son delegables, asistidas o no delegables. | Decisiones legales, regulatorias o de compliance sin especialistas. |

| Qué validación humana necesita cada tipo de output. | Decisiones financieras críticas sin dirección o control financiero. |

| Qué responsable humano debe validar cada flujo. | Compromisos comerciales sensibles sin responsable de negocio. |

| Qué indicadores demostrarán valor real. | La responsabilidad última ante cliente, mercado, consejo o regulador. |

Punt crític

Gestionar agentes no significa entregar decisiones a la IA. Significa crear una estructura para que la IA produzca trabajo útil bajo dirección humana.

1.4. Por qué esta función pertenece al terreno del management

La gestión de agentes tiene una dimensión técnica, pero su núcleo no es técnico. Es directivo. La pregunta central no es qué modelo usar, sino qué trabajo debe cambiar, qué proceso mejora, qué riesgo se acepta, qué responsable valida y qué resultado empresarial se espera.

Por eso esta función exige criterio de negocio, comprensión operativa y capacidad de coordinación. IT, datos, legal o compliance pueden ser imprescindibles en muchos usos, pero no sustituyen la dirección del sistema de trabajo. Habilitan, protegen y dan soporte. La decisión de dónde aplicar agentes y cómo convertirlos en valor pertenece al management.

1.5. Qué debe quedarse una empresa de esta definición

El manager de agentes de IA no debe entenderse como una moda ni como un nuevo título para vestir proyectos tecnológicos. Debe entenderse como una función empresarial emergente: alguien debe ordenar qué agentes se usan, para qué trabajo, bajo qué límites, con qué validación y con qué impacto esperado.

En algunas empresas será un cargo formal. En otras será una responsabilidad asumida por dirección, operaciones, tecnología, marketing, ventas o una capa externa de dirección. La forma puede variar. La función no debería quedar vacía.

- Un manager de agentes de IA no es un prompt engineer ni un perfil técnico-operativo más.

- Su función es dirigir trabajo aumentado: procesos, datos, límites, outputs, validación y medición de valor.

- La gestión de agentes tiene implicaciones técnicas, pero su núcleo es directivo y operativo.

- La empresa que escale agentes necesitará que alguien gobierne esa capacidad con criterio, autoridad y responsabilidad.

2. Por qué esta función empieza a ser relevante ahora

La gestión de agentes de IA empieza a ser relevante porque la inteligencia artificial está saliendo del uso individual y entrando en procesos de empresa. Ya no hablamos solo de redactar más rápido, resumir información o generar ideas. Hablamos de agentes capaces de intervenir en flujos de trabajo, preparar entregables, conectar herramientas, clasificar información, asistir decisiones y ejecutar tareas con distintos grados de autonomía.

Ese cambio obliga a una pregunta distinta. La cuestión ya no es si la empresa usa IA, sino si tiene capacidad para dirigirla cuando empieza a producir trabajo real.

2.1. La IA deja de ser asistencia individual y empieza a ser infraestructura de trabajo

La primera ola de adopción de IA en empresas ha estado marcada por la productividad personal: redactar, resumir, traducir, buscar ideas, analizar documentos o preparar borradores. Esa fase sigue siendo útil, pero no cambia por sí sola la arquitectura del trabajo.

La segunda fase es más profunda. Los agentes empiezan a formar parte de procesos: atención al cliente, ventas, marketing, operaciones, reporting, documentación, análisis competitivo, soporte interno o desarrollo de herramientas. Ahí la IA deja de ser una ayuda puntual y pasa a ser una capa operativa.

Cambio de fase

La productividad individual mejora tareas. La gestión de agentes rediseña cómo se produce, se revisa y se decide dentro de una empresa.

2.2. Los datos ya apuntan a una nueva capa de trabajo

Los datos disponibles no indican una adopción madura y ordenada en todas las empresas. Indican algo más concreto: la conversación sobre agentes ya está entrando en decisiones de negocio, mercado laboral y transformación organizativa.

Fuentes de referencia

Estos datos se apoyan en informes recientes de PwC, Stanford AI Index i Gartner.

2.3. La señal importante no es solo la adopción, sino la brecha de gestión

Que más empresas adopten agentes no significa que sepan dirigirlos. De hecho, el dato de Gartner sobre posibles cancelaciones apunta justo al problema que debería preocupar a una dirección: coste creciente, valor de negocio poco claro y controles de riesgo insuficientes.

Ese patrón no suele resolverse con más tecnología. Se resuelve con mejor management: procesos bien elegidos, responsables claros, criterios de validación, métricas de valor y límites sobre qué puede hacer cada agente.

Adopción sin gestión

- Herramientas dispersas.

- Outputs sin responsable.

- Pilotos sin métrica clara.

- Automatizaciones sin integración.

- Riesgos detectados tarde.

Adopción dirigida

- Procesos priorizados.

- Responsables humanos asignados.

- Validación definida desde el inicio.

- Valor medido en tiempo, calidad, coste o fricción.

- Riesgos, permisos y datos bajo control.

El problema no será falta de IA. Será falta de capacidad directiva para convertir IA en sistema de trabajo útil.

2.4. El mercado laboral ya empieza a reflejar esta transición

La aparición de términos como AI agent manager, AI workforce manager o agent boss muestra que el mercado empieza a nombrar una función que muchas empresas todavía no tienen formalizada. Microsoft, por ejemplo, ha utilizado el concepto de agent boss para describir a profesionales que construyen, delegan y gestionan agentes dentro de equipos híbridos. Ver Microsoft Work Trend Index 2025 .

El término concreto puede variar. Lo relevante es la función: dirigir sistemas donde parte del trabajo se ejecuta por personas y parte por agentes. En algunos organigramas será un cargo nuevo. En otros será una competencia que tendrán que asumir managers, responsables de operaciones, tecnología, producto, marketing, ventas o dirección general.

Lectura de talento

El nombre del rol puede cambiar. La necesidad no: alguien tendrá que traducir objetivos de negocio en procesos donde agentes, personas, datos y validación funcionen con una lógica común.

2.5. La demanda de management no desaparece: se desplaza

Una lectura simplista diría que, si la IA ejecuta más tareas, hará falta menos management. Pero algunos datos apuntan a una lectura más matizada. IESE ha analizado una muestra amplia de ofertas de empleo y vincula una mayor adopción de IA con más demanda de puestos de gestión, no con su desaparición automática. Ver análisis de IESE sobre IA y demanda de management .

Esto encaja con la tesis de fondo del artículo: cuando aumenta la capacidad de ejecución, aumenta también la necesidad de dirección cualificada. No necesariamente más capas jerárquicas, pero sí más capacidad para diseñar sistemas, validar resultados, priorizar usos y responder por las decisiones.

2.6. Por qué este cambio importa especialmente a pymes, startups y scaleups

En una gran empresa, la gestión de agentes puede terminar repartida entre tecnología, datos, operaciones, legal, compliance, recursos humanos y áreas funcionales. En una pyme o startup, la realidad suele ser más directa: menos estructura, menos especialistas y menos margen para absorber iniciativas mal diseñadas.

Eso convierte a los agentes en una oportunidad y en un riesgo. Pueden permitir acceso a capacidades que antes exigían más equipo, más proveedores o más tiempo. Pero también pueden crear una capa nueva de actividad si se implantan sin foco, sin responsable y sin medición.

| Oportunidad | Riesgo si no hay dirección |

|---|---|

| Más capacidad de análisis sin inflar estructura. | Más informes, datos o hipótesis sin decisión clara. |

| Más velocidad para preparar contenidos, propuestas o materiales. | Más producción sin coherencia de marca, criterio o validación. |

| Más autonomía para prototipar herramientas, procesos o flujos. | Más automatizaciones dispersas y difíciles de mantener. |

| Menor dependencia de capas externas para primeras versiones. | Falsa sensación de autosuficiencia en tareas que aún requieren especialistas. |

Para una pyme, los agentes pueden ser una ventaja estructural. Pero solo si alguien los dirige como parte del negocio, no como una colección de herramientas.

2.7. Qué debe quedarse una dirección de este cambio

Esta función empieza a ser relevante ahora porque los agentes están entrando en el trabajo real de la empresa antes de que muchas organizaciones hayan definido cómo gobernarlos. La brecha no está solo en tecnología. Está en dirección, procesos, datos, responsabilidad y medición de valor.

Por eso el debate no debería limitarse a qué herramienta usar. La pregunta directiva es más exigente: qué capacidad necesita construir la empresa para dirigir agentes sin perder foco, control ni responsabilidad.

- La IA está pasando de asistencia individual a capa operativa dentro de procesos reales.

- Los datos muestran adopción, nuevos roles y también riesgo de fracaso por falta de valor o control.

- La necesidad de management no desaparece: se desplaza hacia diseño de sistemas, validación, medición y responsabilidad.

- En pymes, startups y scaleups, la oportunidad es fuerte, pero también lo es el riesgo de implantar agentes sin dirección.

3. Del manager tradicional al manager de agentes

El manager tradicional dirigía principalmente personas que producían trabajo. El manager de agentes tendrá que dirigir sistemas donde el trabajo se reparte entre personas, agentes, datos, automatizaciones, herramientas y proveedores.

Este es el punto de inflexión. No hablamos solo de usar IA para ser más productivos. Hablamos de una nueva forma de organizar la ejecución: quién hace qué, con qué información, bajo qué criterios, con qué validación y con qué responsabilidad.

3.1. El cambio no está en mandar menos, sino en diseñar mejor

En una organización tradicional, buena parte del trabajo directivo consiste en asignar tareas, resolver bloqueos, coordinar equipos, revisar entregables y mantener foco sobre prioridades. Esa función seguirá siendo necesaria.

Lo que cambia es el diseño del sistema. Si una parte del trabajo pasa a ser ejecutada por agentes, el manager debe decidir qué tareas se delegan, qué outputs se aceptan, qué criterios de revisión se aplican y qué decisiones siguen dependiendo exclusivamente de personas.

Cambio de función

El manager de agentes no se limita a repartir trabajo. Diseña cómo se produce, cómo se valida y cómo se convierte en decisión dentro de la empresa.

3.2. Manager tradicional vs. manager de agentes

La comparación útil no es “personas frente a IA”. Esa lectura es pobre. La comparación relevante está en el tipo de sistema que cada manager debe gobernar.

| Manager tradicional | Manager de agentes de IA |

|---|---|

| Coordina personas, equipos y proveedores. | Coordina personas, agentes, herramientas, datos y flujos de trabajo. |

| Reparte tareas según rol, capacidad y disponibilidad. | Define qué tareas se delegan, se asisten o permanecen bajo ejecución humana. |

| Supervisa entregables producidos por equipos humanos. | Supervisa outputs generados por agentes y define su nivel de validación. |

| Gestiona prioridades, carga de trabajo y coordinación. | Gestiona prioridades, autonomía, permisos, datos, calidad y trazabilidad. |

| Escala capacidad contratando, externalizando o reorganizando equipos. | Escala capacidad combinando talento interno, agentes, automatizaciones y procesos rediseñados. |

| Evalúa rendimiento de personas o áreas. | Evalúa rendimiento del sistema: personas + agentes + datos + procesos + decisiones. |

La diferencia no está en que el manager de agentes “use IA”. Está en que sabe convertir IA en capacidad operativa gobernada.

3.3. La empresa no necesitará menos management, sino management más cualificado

Una lectura superficial diría que, si los agentes ejecutan más tareas, harán falta menos managers. En algunos ámbitos puede reducirse supervisión operativa básica. Pero cuando una empresa quiere escalar agentes de forma seria, la conclusión es distinta: necesita management más cualificado.

Igual que una empresa no escala solo por contratar buenos profesionales, tampoco escalará solo por incorporar agentes. La diferencia estará en la calidad de quienes sepan dirigir esa nueva capacidad: elegir procesos, fijar límites, validar outputs, medir valor y proteger la responsabilidad empresarial.

- Más producción.

- Más borradores.

- Más automatizaciones.

- Más análisis preliminares.

- Más herramientas conectadas.

- Más foco.

- Más criterio de uso.

- Más control sobre riesgos.

- Más validación humana.

- Más conexión con resultados de negocio.

Lectura de talento

La gestión de agentes de IA no será una competencia menor. Igual que el management de equipos humanos separa empresas ordenadas de empresas desbordadas, la capacidad de dirigir agentes separará empresas aumentadas de empresas simplemente automatizadas.

3.4. La competencia crítica no es técnica: es negocio, proceso y riesgo

Gestionar agentes exige comprensión tecnológica, pero no se reduce a tecnología. El manager de agentes debe entender qué mueve el negocio, dónde se genera valor, qué procesos son críticos, qué decisiones no pueden automatizarse y qué consecuencias puede tener un output incorrecto.

IT, datos, legal, compliance y seguridad serán piezas importantes en muchos usos. Pero la dirección de agentes no puede quedar encerrada ahí, porque los agentes no impactan solo en sistemas: impactan en clientes, operaciones, ventas, marketing, finanzas, soporte, reputación y toma de decisiones.

| Capacidad | Per què importa | Què evita |

|---|---|---|

| Criterio de negocio | Permite distinguir automatización útil de automatización decorativa. | Invertir en agentes que producen actividad, pero no resultado. |

| Diseño de procesos | Permite integrar agentes dentro del flujo real de trabajo. | Crear herramientas aisladas que nadie usa de forma consistente. |

| Comprensión de datos | Permite evaluar qué información alimenta al agente y con qué calidad. | Tomar outputs como válidos aunque partan de datos débiles. |

| Gestión de riesgos | Permite definir permisos, límites, trazabilidad y escalado humano. | Delegar tareas sensibles sin control suficiente. |

| Capacidad de validación | Permite separar borrador, análisis preliminar y decisión empresarial. | Convertir outputs rápidos en decisiones precipitadas. |

| Liderazgo operativo | Permite coordinar personas, agentes y áreas funcionales. | Que cada departamento use IA de forma distinta, sin sistema común. |

3.5. El error: tratarlos como empleados o como herramientas aisladas

Un agente no es una persona. No tiene criterio propio de negocio, no asume responsabilidad, no interpreta cultura interna y no responde por las consecuencias de su trabajo. Tratarlo como un empleado puede llevar a delegar demasiado.

Pero tampoco debe tratarse como una herramienta pasiva más. Si se usa solo como una utilidad aislada, la empresa puede acumular asistentes, automatizaciones y conectores sin cambiar realmente su forma de trabajar.

Si se trata como empleado

- Se le concede autonomía excesiva.

- Se confunde output con criterio.

- Se diluye la responsabilidad humana.

- Se automatizan decisiones sensibles.

Si se trata como herramienta aislada

- Se usa sin integrarlo en procesos.

- Cada área aplica criterios distintos.

- No hay trazabilidad ni aprendizaje común.

- La mejora queda limitada a productividad local.

El punto correcto está en medio: un agente puede ejecutar partes relevantes del trabajo, pero necesita contexto, límites, supervisión y validación humana.

3.6. El salto real: de supervisar tareas a gobernar sistemas de trabajo

El cambio más importante no es que el manager tenga nuevas herramientas. Es que tendrá que gobernar sistemas donde las tareas se reparten entre personas, agentes, automatizaciones y proveedores. Eso exige una mirada distinta: menos centrada en quién ejecuta cada tarea y más centrada en cómo se produce, se valida y se decide.

En ese contexto, el manager de agentes debe responder preguntas que antes apenas existían: qué agente interviene en cada fase, qué información puede usar, qué margen de autonomía tiene, qué output se considera aceptable, quién revisa errores y qué registro queda si algo falla.

3.7. Qué debe quedarse una empresa de este cambio de rol

El paso del manager tradicional al manager de agentes no debe leerse como sustitución directa. Debe leerse como evolución de la función directiva. Las empresas seguirán necesitando liderazgo humano, coordinación, criterio y responsabilidad, pero deberán aplicarlo a un entorno operativo más complejo.

La empresa que entienda este cambio antes tendrá ventaja. No porque use más IA, sino porque podrá convertirla en estructura: tareas mejor diseñadas, outputs mejor validados, procesos más rápidos, menos fricción y decisiones más trazables.

- El manager tradicional no desaparece, pero su perímetro se amplía: personas, agentes, herramientas, datos y procesos.

- La gestión de agentes exige talento directivo cualificado, no solo conocimiento técnico o familiaridad con herramientas.

- El error está en tratar los agentes como empleados autónomos o como herramientas aisladas sin integración real.

- La nueva función directiva consiste en gobernar sistemas híbridos donde producción, validación y decisión estén claramente separadas.

4. Qué puede asumir un agente hoy y qué debe seguir validando una persona

Para implantar agentes con criterio, una empresa debe evitar dos errores. El primero es infravalorarlos y tratarlos como simples asistentes para tareas menores. El segundo es sobredimensionarlos y asumir que pueden sustituir sin más profesiones, áreas funcionales o responsabilidad empresarial.

La lectura correcta está en el nivel de tarea. Los agentes pueden absorber partes relevantes del trabajo: recopilar información, preparar borradores, clasificar datos, analizar patrones, documentar procesos, proponer escenarios o ejecutar pasos dentro de un flujo. Pero eso no equivale a delegar criterio, responsabilidad ni decisión final.

4.1. La pregunta no es qué puede hacer la IA, sino qué conviene delegar

Que un agente pueda redactar, analizar, responder, clasificar o programar no significa que deba hacerlo en cualquier contexto ni con cualquier autonomía. La capacidad técnica no basta. Hay que valorar riesgo, impacto, calidad del dato, posibilidad de revisión y consecuencia del error.

Por eso la pregunta directiva no debería ser “qué agente podemos usar”, sino qué trabajo es repetible, documentable, revisable y suficientemente controlable como para delegarse total o parcialmente.

Pregunta correcta

Antes de elegir herramienta, la empresa debe decidir qué tareas puede delegar sin perder criterio, control, trazabilidad ni responsabilidad.

4.2. Matriz práctica: qué puede hacer un agente y qué debe validar una persona

Esta matriz no pretende cerrar el debate. La tecnología evoluciona rápido. Pero sirve como referencia actual para empresas que quieren empezar a trabajar con agentes sin convertir la IA en automatización desordenada.

| Área de trabajo | Qué puede asumir un agente hoy | Qué debe validar o decidir una persona |

|---|---|---|

| Investigación estratégica | Recopilar información, ordenar fuentes, comparar tendencias y sintetizar señales. | Qué fuentes son fiables, qué señal importa y qué lectura estratégica se extrae. |

| Análisis competitivo | Identificar competidores, comparar mensajes, mapear propuestas y preparar benchmarking inicial. | La interpretación del posicionamiento, la diferenciación real y la implicación comercial. |

| Contenido y comunicación | Generar estructuras, borradores, titulares, FAQs, variantes de copy y adaptaciones por canal. | La tesis, la voz de marca, la precisión, el riesgo reputacional y la coherencia editorial. |

| Diseño y creatividad | Proponer conceptos visuales, composiciones preliminares, imágenes, gráficos y variaciones de estilo. | La dirección creativa, la calidad final, el mensaje y el encaje con la identidad de marca. |

| Programación y herramientas | Generar código, depurar errores, estructurar prototipos, preparar scripts y documentar lógica. | La arquitectura, la seguridad, la robustez, la escalabilidad y la validación técnica final. |

| Màrqueting i vendes | Preparar hipótesis de campaña, segmentaciones iniciales, copies, argumentarios y análisis de embudo. | La inversión, el enfoque comercial, el timing, el riesgo de mensaje y la prioridad de mercado. |

| Atenció al client | Clasificar consultas, preparar respuestas, resumir incidencias y resolver casos simples bajo reglas. | Reclamaciones, excepciones, compensaciones, tono y decisiones con impacto en cliente. |

| Finanzas y pricing | Preparar escenarios, ordenar costes, calcular márgenes y simular hipótesis. | Supuestos, política de precios, riesgos financieros y compromisos económicos. |

| Operacions | Documentar procesos, crear checklists, detectar cuellos de botella y proponer secuencias. | Prioridades, responsables, impacto en equipo y decisiones de ejecución. |

| Dirección estratégica | Preparar opciones, estructurar escenarios, resumir información y anticipar implicaciones. | Elegir rumbo, asumir trade-offs, priorizar recursos y responder por la decisión final. |

El agente puede preparar mejor el terreno. Pero la decisión empresarial sigue necesitando contexto, criterio y responsabilidad humana.

4.3. Tres tipos de tareas: delegables, asistidas y no delegables

La empresa no debería decidir caso por caso de forma improvisada. Necesita una clasificación sencilla para evitar tanto la infrautilización como la delegación excesiva. Una primera división útil es separar tareas delegables, tareas asistidas y tareas no delegables.

Tareas delegables

Son repetibles, documentables, de bajo riesgo y con criterios claros de revisión.

- Clasificación de información.

- Resúmenes internos.

- Primeros borradores.

- Extracción de patrones.

Tareas asistidas

El agente prepara, propone o acelera, pero una persona interpreta, adapta o decide.

- Análisis competitivo.

- Propuestas comerciales.

- Escenarios financieros.

- Campañas y mensajes.

Tareas no delegables

No deberían delegarse en agentes las decisiones estratégicas finales, la responsabilidad ante clientes, la interpretación legal sensible, las decisiones financieras críticas, los compromisos comerciales relevantes ni la gestión de conflictos con impacto reputacional o contractual.

4.4. La autonomía debe crecer según la capacidad de gobierno

La gestión de agentes no funciona como un interruptor de encendido o apagado. Una empresa puede empezar con autonomía baja, avanzar hacia autonomía media y solo valorar autonomía alta en procesos muy acotados, con datos adecuados, reglas claras, permisos definidos y supervisión suficiente.

Esta escala evita dos errores: dejar la IA reducida a una ayuda menor o conceder autonomía antes de que la empresa pueda controlar el impacto del agente sobre procesos reales.

| Nivel de autonomía | Qué hace el agente | Control humano necesario |

|---|---|---|

| Baixa | Asiste, redacta, resume, propone o clasifica, pero no actúa sin revisión. | Revisión humana antes de cualquier uso externo o decisión. |

| Mitjana | Ejecuta tareas dentro de un flujo definido y con reglas claras. | Supervisión periódica, criterios de calidad y responsable asignado. |

| Alta | Actúa con mayor autonomía sobre procesos acotados y sistemas conectados. | Permisos estrictos, trazabilidad, auditoría, límites de actuación y escalado automático. |

4.5. Qué debe quedarse una empresa de esta matriz

La gestión de agentes empieza por una separación básica: producir no es validar, validar no es decidir y decidir no es responder. Una empresa puede apoyarse en agentes para acelerar muchas tareas, pero debe mantener claro qué parte del proceso requiere intervención humana.

Esta separación es especialmente importante en pymes y startups. Precisamente porque los agentes permiten internalizar más capacidad, también aumentan la tentación de delegar más de lo que la empresa está preparada para controlar.

- Los agentes pueden absorber tareas relevantes, pero no deben asumir criterio, responsabilidad ni decisiones críticas.

- La empresa debe separar tareas delegables, tareas asistidas y tareas no delegables.

- La autonomía de los agentes debe aumentar solo cuando existan datos, límites, responsables, trazabilidad y validación.

- El valor no está en delegar más, sino en delegar mejor: con control, utilidad y conexión real con el negocio.

5. Dirección aumentada en la práctica: el caso de Rumbo & Resultados

La gestión de agentes de IA no es una hipótesis futurista para Rumbo & Resultados. Forma parte de su forma real de trabajar. No como empresa dirigida por IA, sino como firma dirigida desde criterio senior que utiliza agentes para ampliar capacidad, acelerar producción y reducir fricción operativa.

Este matiz es importante. La IA no define el rumbo, no decide prioridades y no asume responsabilidad. Actúa como una capa de apoyo para investigar, estructurar, contrastar, prototipar, producir primeras versiones y preparar materiales que después pasan por criterio, revisión y decisión humana.

5.1. No es una empresa automatizada: es una dirección aumentada

Una empresa automatizada delega demasiado pronto. Una dirección aumentada hace otra cosa: usa agentes para ampliar capacidad sin desplazar el juicio directivo. La diferencia no está en usar más IA, sino en mantener claro qué parte del trabajo puede acelerarse y qué parte sigue dependiendo de experiencia, contexto y responsabilidad.

En R&R, los agentes ayudan a preparar trabajo que antes habría exigido más tiempo, más proveedores o más capas de apoyo. Pero la arquitectura del servicio, el posicionamiento, la lectura comercial, las prioridades y la validación final siguen dependiendo de dirección humana.

- Delega por velocidad.

- Confunde output con avance.

- Reduce revisión para producir más.

- Acumula herramientas sin sistema.

- Usa agentes con intención.

- Convierte producción en material revisable.

- Mantiene criterio humano en decisiones críticas.

- Integra agentes dentro de una forma estable de trabajar.

5.2. Qué permite esta forma de trabajar

Hace pocos años, una firma como R&R habría necesitado más estructura externa para sostener el mismo nivel de investigación, producción, prototipado, documentación y desarrollo de materiales. La diferencia no está solo en producir más rápido, sino en poder convertir criterio senior en trabajo operativo sin depender de tantas capas intermedias desde el inicio.

Los agentes no eliminan todos esos perfiles ni sustituyen su valor cuando hacen falta. Lo que cambian es la fase inicial del trabajo: permiten llegar antes a una hipótesis, una estructura, un borrador, un prototipo, una matriz, una pieza visual o una primera versión operativa sobre la que aplicar criterio senior.

| Área de trabajo | Qué aceleran los agentes | Qué sigue siendo dirección humana |

|---|---|---|

| Research y análisis | Recopilar información, ordenar fuentes, comparar señales y preparar bases de contraste. | Interpretar qué importa, qué no y qué lectura tiene valor para una empresa concreta. |

| Contenido de autoridad | Preparar estructuras, borradores, FAQs, enfoques SEO/AIO/AEO/GEO y variantes editoriales. | Definir tesis, tono, posicionamiento, profundidad y decisión final de publicación. |

| Materiales comerciales | Generar argumentarios, matrices, fichas, propuestas preliminares y adaptaciones por público. | Decidir oferta, promesa defendible, pricing, enfoque comercial y encaje con la estrategia. |

| Diseño y visualización | Explorar conceptos visuales, gráficos, composiciones, imágenes y piezas para contenidos. | Seleccionar dirección creativa, coherencia de marca, mensaje y calidad final. |

| Herramientas y prototipos | Apoyar HTML, CSS, JS, PHP, shortcodes, lógica de cálculo, pruebas y depuración inicial. | Definir utilidad, arquitectura funcional, experiencia de usuario, límites y publicación. |

| Escenarios económicos | Ordenar costes, márgenes, hipótesis, alternativas y primeras estructuras de análisis. | Validar supuestos, prioridades, trade-offs y decisiones con impacto real en negocio. |

La ventaja no está en producir una primera versión más rápido. Está en llegar antes a una versión que merece ser revisada, mejorada y convertida en decisión.

5.3. Reducir dependencia no significa sustituir criterio experto

La dirección aumentada reduce dependencia de algunas capas externas en fases iniciales: research preliminar, primeras versiones de contenido, prototipos visuales, documentación, análisis de escenarios o estructuración de materiales. Eso mejora velocidad y control.

Pero no significa negar el valor de especialistas. Hay situaciones donde seguirá siendo necesario contar con diseñadores, programadores, asesores legales, expertos financieros, técnicos sectoriales o proveedores especializados. La diferencia es que la empresa llega a esas conversaciones con más preparación y menos dependencia de empezar desde cero.

Matiz necesario

La dirección aumentada no consiste en sustituir siempre proveedores o perfiles especializados. Consiste en internalizar más capacidad inicial, decidir mejor qué se externaliza y llegar a cada fase con más control.

5.4. Qué demuestra este caso para una pyme o startup

El caso de R&R no pretende ser un modelo universal. Sirve para demostrar una idea concreta: una organización pequeña puede operar con más capacidad si combina criterio senior, método, agentes de IA y validación humana.

Esa combinación permite competir de otra forma. No porque la IA lo haga todo, sino porque reduce fricción entre idea, análisis, producción, prototipo y ejecución. En una pyme o startup, esa reducción de fricción puede ser diferencial si se gobierna con criterio.

Lo que permite

- Más velocidad de preparación.

- Más capacidad de iteración.

- Menos dependencia de primeras versiones externas.

- Más control sobre hipótesis, materiales y prototipos.

La condición

- No delegar el rumbo.

- No publicar sin revisión.

- No confundir producción con criterio.

- No automatizar sin responsabilidad humana.

5.5. Qué debe quedarse una empresa de este ejemplo

La gestión de agentes no empieza cuando una empresa compra una herramienta. Empieza cuando aprende a dirigir una nueva capa de capacidad artificial sin perder foco, control ni responsabilidad.

Esa es la lección útil. Los agentes pueden acelerar mucho trabajo. Pero solo generan ventaja cuando se integran en una forma de operar donde alguien decide qué pedir, qué revisar, qué descartar, qué mejorar y qué convertir en acción.

- R&R usa agentes como capa de apoyo operativo, no como sustituto de la dirección.

- La IA permite reducir fricción, acelerar primeras versiones y ampliar capacidad sin inflar estructura.

- Reducir dependencia de capas externas no significa prescindir siempre de especialistas.

- La ventaja aparece cuando criterio senior, método, agentes y validación humana trabajan como sistema.

6. El riesgo de implantar agentes sin gobierno

La implantación de agentes de IA no falla solo por falta de tecnología. Falla cuando la empresa no ha definido qué proceso quiere mejorar, qué datos puede usar el agente, qué límites tiene, quién revisa sus outputs y qué valor debe generar.

Este es el riesgo real: incorporar agentes como una capa más de producción sin haber creado antes una capa mínima de dirección, control y trazabilidad. En ese caso, la empresa puede producir más, responder más rápido y automatizar más tareas, pero no necesariamente trabajar mejor.

6.1. La advertencia ya está encima de la mesa

Gartner ha advertido que más del 40% de los proyectos de agentic AI podrían cancelarse antes de finales de 2027 por costes crecientes, valor de negocio poco claro o controles de riesgo insuficientes. Ver nota de Gartner sobre agentic AI .

El dato no dice que los agentes no tengan recorrido. Dice algo más útil para una dirección: muchos proyectos no fallarán por falta de IA, sino por falta de foco, integración, métricas y control.

Lectura executiva

Antes de escalar agentes, la empresa debe saber qué problema resuelven, cuánto valor aportan, qué riesgos introducen y quién responde por el resultado.

6.2. Agent washing: llamar agente a cualquier automatización

El primer riesgo es conceptual: llamar agente a cualquier automatización, asistente o flujo parcialmente inteligente. Ese agent washing puede inflar expectativas, justificar compras débiles y hacer que la empresa crea que está incorporando inteligencia operativa cuando solo está añadiendo una capa de automatización básica.

| Concepto | Qué suele hacer | Riesgo si se confunde |

|---|---|---|

| Automatización | Ejecuta reglas predefinidas sobre tareas repetibles. | Creer que hay inteligencia donde solo hay ejecución mecánica. |

| Asistente de IA | Responde, redacta, resume o propone bajo petición humana. | Tratar una ayuda puntual como si fuera un sistema autónomo. |

| Agente de IA | Actúa sobre objetivos, tareas o flujos definidos, con cierto grado de autonomía. | Delegar trabajo sin definir límites, validación y responsabilidad. |

Antes de implantar agentes, una empresa debe saber si está incorporando capacidad operativa real, automatización básica o solo una interfaz más cómoda.

6.3. Shadow AI: cuando la IA ya se usa, pero la empresa no lo sabe bien

El segundo riesgo es el shadow AI: herramientas de IA usadas fuera del mapa formal de la empresa. Equipos que prueban soluciones sin revisión, empleados que suben información a servicios externos, departamentos que automatizan tareas sin criterios comunes o datos sensibles que pasan por sistemas no controlados.

ISACA y otros informes de riesgo ya advierten del impacto del uso no autorizado de IA en exposición de datos, brechas de seguridad y falta de trazabilidad. Para una empresa, la conclusión práctica es clara: lo que no está mapeado no puede gobernarse. Ver análisis de ISACA sobre shadow AI .

Riesgo de shadow AI

Cuando la IA se usa sin mapa, la empresa puede creer que está ganando productividad mientras pierde visibilidad sobre datos, herramientas, permisos, criterios y decisiones.

6.4. Outputs sin dueño: el riesgo más silencioso

Una empresa puede tener un problema serio aunque ningún agente falle de forma evidente. Basta con que los outputs empiecen a circular sin dueño claro: informes que nadie valida, respuestas que nadie revisa, análisis que se toman como ciertos o propuestas que avanzan sobre hipótesis débiles.

Este riesgo es peligroso porque la IA produce material con apariencia de solidez. Un texto puede sonar bien. Una tabla puede parecer precisa. Un análisis puede estar bien estructurado. Pero la forma no garantiza que el output sea correcto, suficiente o útil para decidir.

Output sin dueño

- No queda claro quién pidió el trabajo.

- No queda claro qué datos se usaron.

- No queda claro quién revisó el resultado.

- No queda claro si puede usarse para decidir.

Output gobernado

- Tiene objetivo definido.

- Tiene responsable humano.

- Tiene criterio de revisión.

- Tiene límite claro de uso.

6.5. Datos, permisos y trazabilidad: el punto donde el riesgo cambia de escala

El riesgo aumenta cuando los agentes dejan de generar solo texto y empiezan a conectarse con documentos, CRM, ERP, bases de datos, correo, atención al cliente, reporting o herramientas internas. En ese momento ya no hablamos solo de productividad. Hablamos de acceso a información, permisos, acciones y posibles impactos en procesos reales.

Por eso una empresa necesita reglas mínimas antes de conectar agentes a sistemas relevantes. No hace falta burocratizar cada prueba, pero sí establecer controles proporcionales al riesgo.

| Control | Pregunta que debe responder | Riesgo si no existe |

|---|---|---|

| Dades | ¿Qué información puede usar el agente y qué información queda excluida? | Exposición de datos sensibles o uso de información inadecuada. |

| Permisos | ¿Qué sistemas puede consultar, modificar o activar? | Acciones no controladas sobre procesos o información crítica. |

| Validación | ¿Qué outputs necesitan revisión humana antes de usarse? | Decisiones tomadas sobre resultados no verificados. |

| Registro | ¿Qué queda documentado sobre instrucciones, outputs y revisiones? | Falta de trazabilidad si aparece un error o reclamación. |

| Escalado | ¿Cuándo debe intervenir una persona? | Automatizar situaciones sensibles que requieren criterio humano. |

Marco de referencia

Marcos como el NIST AI Risk Management Framework i el AI Act europeu apuntan en la misma dirección práctica: mapear usos, definir responsables, establecer controles, supervisar riesgos y mantener trazabilidad.

6.6. Mapa simple de riesgos al implantar agentes

Antes de escalar agentes, la empresa debería construir al menos un mapa básico de riesgos. No para frenar la adopción, sino para saber qué debe vigilar desde el primer día.

Para profundizar en responsabilidad y seguros

Este bloque no desarrolla en detalle la dimensión aseguradora, legal o de responsabilidad profesional. Para esa capa, conviene revisar también el análisis específico sobre IA, responsabilidad civil, D&O, ciber, trazabilidad y seguros empresariales publicado en Rumbo & Resultados. Leer artículo sobre IA, responsabilidad y seguros empresariales .

Nota de edición: sustituir el enlace cuando esté confirmada la URL final del artículo interno.

6.7. Qué debe quedarse una empresa de este bloque

Implantar agentes sin gobierno puede parecer rápido al principio y caro después. El coste no aparece solo en licencias o tecnología. Aparece en retrabajo, errores, datos mal usados, decisiones débiles, falta de trazabilidad y pérdida de control sobre procesos que empiezan a depender de IA.

La respuesta no es frenar la adopción. Es hacerla gobernable: procesos concretos, responsables claros, límites definidos, validación humana y métricas de valor. Esa es la diferencia entre experimentar con IA y empezar a dirigir agentes.

- El riesgo no está en usar agentes de IA, sino en usarlos sin objetivos, límites, responsables ni validación.

- Agent washing, shadow AI, outputs sin dueño y autonomía prematura pueden convertir la IA en una fuente de desorden.

- El control mínimo debe cubrir datos, permisos, validación, registro, escalado y responsabilidad.

- La productividad real no se mide por cantidad de outputs, sino por mejora de decisión, ejecución, calidad y reducción de fricción.

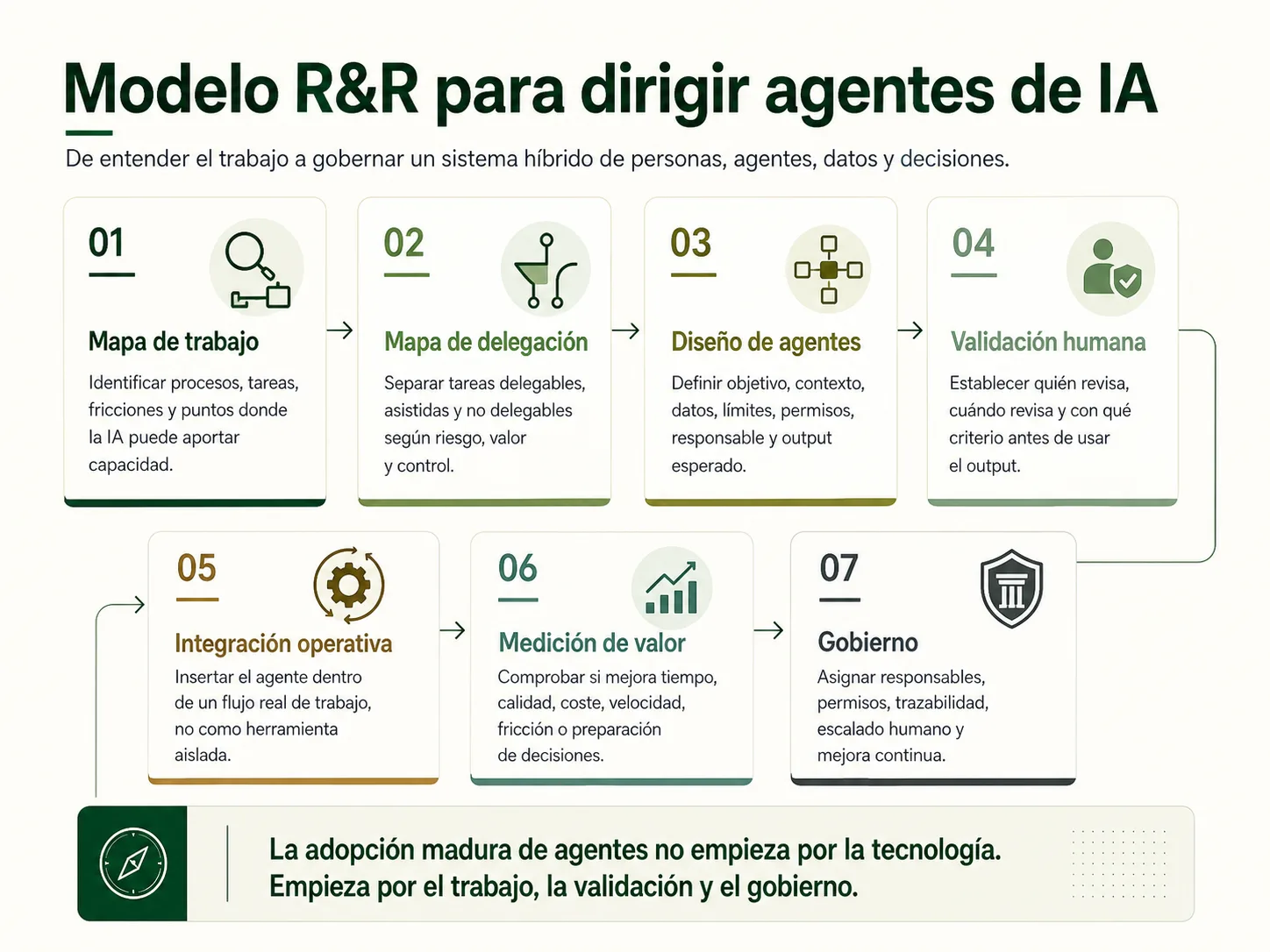

7. Modelo R&R para dirigir agentes de IA en empresa

Una empresa no debería empezar la implantación de agentes preguntando qué herramienta comprar. Esa pregunta llega después. Primero debe entender qué trabajo quiere rediseñar, qué tareas puede delegar, qué riesgos aparecen, quién valida y cómo se medirá si el nuevo sistema aporta valor real.

El Modelo R&R para dirigir agentes de IA ordena esa transición en siete fases. Su objetivo no es convertir la adopción de IA en un proceso pesado, sino evitar que la empresa empiece por el final: herramientas, pilotos y automatizaciones antes de haber definido trabajo, criterio y gobierno.

7.1. Las siete fases del modelo

El modelo funciona como una secuencia de decisión. Cada fase responde a una pregunta directiva y debe producir un resultado concreto. Si una fase queda débil, la siguiente parte de una base incompleta.

| Fase | Pregunta directiva | Resultat esperat |

|---|---|---|

| 1. Mapa de trabajo | ¿Dónde se consume hoy tiempo, criterio, coste o coordinación? | Procesos candidatos para trabajar con agentes. |

| 2. Mapa de delegación | ¿Qué tareas pueden delegarse, asistirse o no delegarse? | Clasificación de tareas según valor, riesgo y control necesario. |

| 3. Diseño de agentes | ¿Qué agente hace qué, con qué datos, límites y entregable? | Agentes definidos por objetivo, contexto, permisos y output esperado. |

| 4. Validación humana | ¿Quién revisa, cuándo revisa y con qué criterio? | Responsables y reglas de validación antes de usar cada output. |

| 5. Integración operativa | ¿Dónde entra el agente dentro del flujo real de trabajo? | Proceso rediseñado con entrada, ejecución, revisión y uso del output. |

| 6. Medición de valor | ¿Qué mejora debe demostrar el agente? | Métricas de tiempo, calidad, coste, velocidad o reducción de fricción. |

| 7. Gobierno | ¿Quién responde, qué se registra y cómo se corrige? | Sistema controlado con responsables, trazabilidad, límites y mejora continua. |

El valor del modelo no está en añadir complejidad. Está en impedir que una empresa confunda probar agentes con dirigirlos.

7.2. Del trabajo al sistema: la lógica del modelo

La secuencia importa. Si la empresa empieza por diseñar agentes sin haber mapeado el trabajo, probablemente automatizará tareas visibles, pero no necesariamente las más relevantes. Si delega sin clasificar riesgos, puede conceder autonomía antes de tiempo. Si integra sin validación, puede usar outputs que nadie ha revisado con criterio suficiente.

Por eso el modelo avanza de forma progresiva: primero entiende el trabajo, después decide qué puede delegarse, luego diseña agentes concretos, define validación humana, los integra en procesos, mide valor y establece gobierno.

7.3. Qué debe producir cada fase

Un modelo solo es útil si genera entregables operativos. En gestión de agentes, esos entregables no tienen que ser documentos extensos. Pueden ser mapas, matrices, criterios, checklists, flujos y métricas suficientes para tomar decisiones.

| Fase | Entregable práctico | Per què serveix |

|---|---|---|

| Mapa de trabajo | Inventario de procesos, tareas, fricciones y cuellos de botella. | Evitar empezar por herramientas sin saber qué trabajo debe cambiar. |

| Mapa de delegación | Matriz de tareas delegables, asistidas y no delegables. | Separar oportunidad de riesgo antes de automatizar. |

| Diseño de agentes | Ficha de cada agente: objetivo, datos, límites, output y responsable. | Evitar agentes ambiguos, sobredimensionados o sin dueño. |

| Validación humana | Checklist de revisión por tipo de output y nivel de riesgo. | Impedir que outputs no revisados entren en decisiones o procesos sensibles. |

| Integración operativa | Flujo rediseñado: entrada, ejecución del agente, revisión y uso del resultado. | Convertir el agente en parte del proceso, no en una herramienta paralela. |

| Medición de valor | Indicadores de impacto: tiempo, calidad, coste, velocidad y fricción. | Demostrar si el agente aporta valor o solo produce más actividad. |

| Govern | Mapa de responsables, permisos, trazabilidad, escalado y revisión periódica. | Mantener control cuando el uso de agentes crece. |

7.4. Cómo se aplica en una pyme, startup o empresa mediana

El modelo no exige empezar con una arquitectura compleja. En una pyme o startup puede aplicarse sobre un único proceso: preparación de propuestas, clasificación de leads, análisis de campañas, atención al cliente, documentación interna, reporting comercial o generación de contenidos.

Lo importante es respetar la lógica: proceso concreto, tarea bien elegida, agente definido, responsable humano, validación suficiente, medición simple y decisión sobre si escalar, corregir o detener el flujo.

Aplicación ligera

- Un proceso acotado.

- Un agente o flujo inicial.

- Un responsable humano.

- Una checklist de validación.

- Tres o cuatro métricas de valor.

Lo que debe evitarse

- Implantar agentes en varias áreas a la vez.

- Escalar antes de medir valor.

- Dar autonomía sin permisos claros.

- Usar outputs sin dueño.

- Confundir piloto con sistema.

7.5. Por qué el modelo es directivo, no técnico

El modelo puede requerir soporte técnico, especialmente cuando hay datos internos, integraciones, permisos, seguridad o automatizaciones conectadas a sistemas empresariales. Pero su lógica no nace de la tecnología. Nace de una pregunta de dirección: qué trabajo debe cambiar y bajo qué condiciones.

Por eso el modelo debe estar gobernado por criterio de negocio y operativo. IT habilita. Datos alimenta. Legal y compliance protegen. Las áreas funcionales conocen el proceso. Pero alguien debe coordinar esa relación para que los agentes no avancen como una suma de pruebas aisladas.

Lectura R&R

La tecnología puede habilitar agentes, pero no decide por sí sola qué trabajo merece ser rediseñado, qué riesgo es aceptable ni qué resultado empresarial justifica la implantación.

7.6. Qué debe quedarse una empresa de este modelo

El Modelo R&R no pretende burocratizar la IA. Pretende convertirla en capacidad gobernada. Una empresa puede empezar de forma pequeña, pero no debería empezar de forma desordenada.

Si el primer agente ya tiene proceso, objetivo, límites, responsable, validación y métrica, la empresa aprende a dirigir IA desde el inicio. Esa disciplina será más importante a medida que los agentes pasen de tareas aisladas a flujos más integrados.

- El Modelo R&R empieza por el trabajo, no por la herramienta.

- Sus siete fases convierten la adopción de agentes en una secuencia de decisión: entender, delegar, diseñar, validar, integrar, medir y gobernar.

- Una pyme puede aplicarlo de forma ligera sobre un único proceso, sin crear una estructura compleja.

- La gestión de agentes tiene soporte técnico, pero su núcleo es directivo: decidir qué trabajo cambia, bajo qué límites y con qué valor esperado.

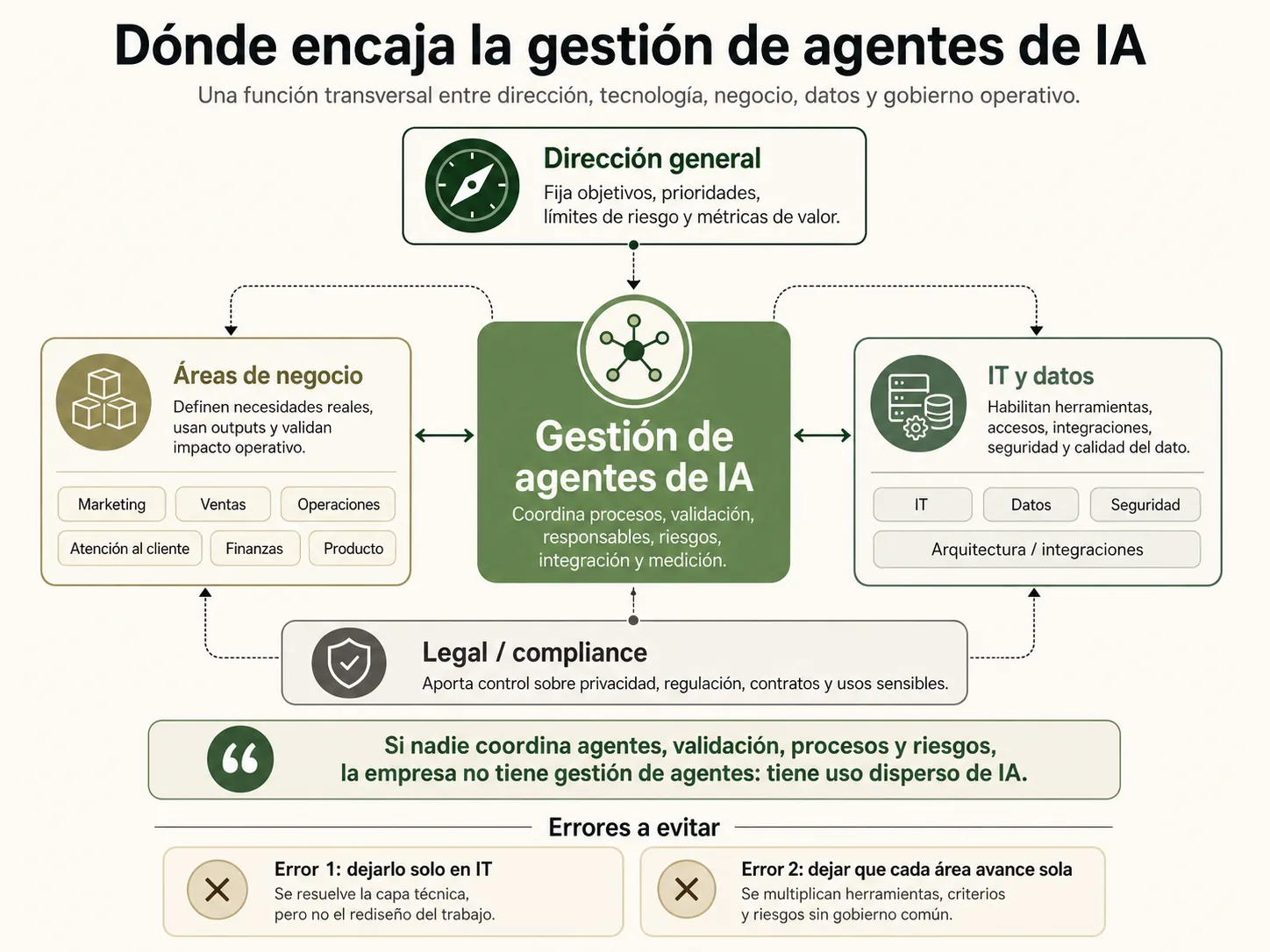

8. Dónde encaja esta función en el organigrama

Una vez definida la función, aparece una pregunta práctica: dónde debe ubicarse la gestión de agentes de IA dentro de la empresa. La respuesta depende del tamaño, la madurez digital, los procesos afectados y el nivel de riesgo. No hay un único organigrama válido.

Lo que sí debe evitarse es que la función quede sin dueño. Si los agentes empiezan a producir trabajo, acceder a datos, apoyar decisiones o interactuar con procesos reales, la empresa necesita saber quién coordina, quién valida y quién responde por esa nueva capacidad.

8.1. No debería quedar encerrada solo en IT

IT será una pieza necesaria. Tendrá que intervenir en seguridad, integraciones, permisos, arquitectura técnica, proveedores, acceso a datos y control de herramientas. Pero la gestión de agentes no puede reducirse a un proyecto tecnológico.

La razón es simple: los agentes no solo afectan a sistemas. Afectan a trabajo, clientes, procesos, decisiones, costes, productividad, reputación y responsabilidad. Por eso la pregunta no es únicamente qué tecnología se puede desplegar, sino qué proceso de negocio merece ser rediseñado y bajo qué condiciones.

IT es necesario, pero no suficiente

La tecnología puede habilitar agentes. Pero la decisión sobre dónde usarlos, qué riesgos aceptar, qué valor deben generar y qué outputs requieren validación pertenece al terreno de dirección y operaciones.

8.2. Tampoco debería quedar dispersa entre áreas

El error contrario es que cada departamento avance por su cuenta. Marketing prueba sus agentes, ventas automatiza propuestas, atención al cliente genera respuestas, operaciones documenta procesos y finanzas prepara escenarios, todo sin un marco común.

Esa dispersión puede parecer positiva al principio porque aumenta la experimentación. Pero a medio plazo crea diferencias de criterio: distintas herramientas, distintos niveles de revisión, distintos permisos, distinta exposición de datos y distintas formas de medir valor.

IA dispersa por áreas

- Cada equipo aplica sus propios criterios.

- No hay mapa común de usos y agentes.

- Se duplican herramientas, flujos y costes.

- La validación depende de cada persona o departamento.

- La dirección pierde visibilidad sobre riesgos y resultados.

Gestión coordinada

- Existe un mapa de agentes, procesos y responsables.

- Hay criterios comunes de validación.

- Se priorizan procesos con impacto real.

- IT, negocio y dirección trabajan con una lógica compartida.

- La empresa mide valor, riesgo y aprendizaje.

8.3. Opciones de encaje según el tipo de empresa

En algunas organizaciones, la gestión de agentes terminará como cargo formal: AI agent manager, AI workforce manager, responsable de IA operativa, responsable de automatización inteligente o una función equivalente.

En otras, especialmente pymes y startups, no será un cargo independiente. Será una responsabilidad asumida por dirección general, operaciones, tecnología, producto, marketing, ventas o una dirección externa. Lo importante no es el título. Lo importante es que la función tenga autoridad, criterio y capacidad de coordinación.

| Tipus d'empresa | Encaje posible | Condició crítica |

|---|---|---|

| Pyme tradicional | Dirección general, operaciones, responsable digital o apoyo externo. | Empezar por procesos concretos, no por herramientas. |

| Startup | Fundador, COO, producto, growth o tecnología con visión transversal. | No escalar agentes sin controles, métricas ni criterios de calidad. |

| Scaleup | Función coordinada entre operaciones, producto, datos, tecnología y dirección. | Unificar criterios antes de que cada área escale agentes por separado. |

| Empresa mediana | Transformación, operaciones, PMO, tecnología o dirección funcional. | Conectar IA con procesos, riesgos, adopción, formación y medición de valor. |

| Gran empresa | Rol formal o equipo específico de gestión de agentes, con IT, datos, legal y negocio. | No convertirlo en una oficina burocrática desconectada del trabajo real. |

El organigrama importa menos que la función. Si nadie coordina agentes, validación, procesos y riesgos, la empresa no tiene gestión de agentes: tiene uso disperso de IA.

8.4. La función necesita autoridad, no solo interés tecnológico

Gestionar agentes no puede depender solo de la persona que más curiosidad tiene por la IA. Esa persona puede ser útil para explorar herramientas, pero una implantación real exige autoridad para ordenar prioridades, pedir cambios de proceso, definir límites y exigir validación.

Si la función no tiene autoridad, los agentes quedan reducidos a experimentos laterales. Si tiene autoridad sin criterio, puede imponer automatizaciones mal diseñadas. La combinación necesaria es otra: criterio de negocio, comprensión operativa, coordinación técnica y capacidad de decisión.

Riesgo habitual

Poner la gestión de agentes en manos de quien más herramientas conoce, pero no de quien entiende mejor el trabajo, puede llevar a automatizar tareas visibles sin resolver problemas reales de negocio.

8.5. Qué debe fijar dirección general

La dirección general no tiene que diseñar cada agente ni revisar cada flujo. Pero sí debe fijar el marco: qué objetivos persigue la empresa con IA, qué riesgos no quiere asumir, qué áreas tienen prioridad y qué nivel de autonomía se permite.

Esta visibilidad directiva es especialmente importante cuando los agentes empiezan a afectar a clientes, costes, datos, procesos, reputación o decisiones. Si la IA toca esas capas, no puede avanzar como una iniciativa lateral.

- Qué objetivos de negocio justifican la implantación de agentes.

- Qué procesos tienen prioridad y cuáles no.

- Qué usos requieren validación obligatoria.

- Qué datos, clientes o decisiones quedan fuera de automatización.

- Qué métricas demostrarán valor real.

8.6. Cómo se coordinan IT, datos, legal y áreas de negocio

La gestión de agentes necesita colaboración transversal. IT y datos habilitan arquitectura, seguridad, permisos, integraciones y calidad de información. Legal y compliance intervienen cuando hay datos sensibles, impacto externo o procesos regulados. Las áreas de negocio conocen el trabajo real y definen qué output tiene valor.

El problema aparece cuando estas capas se incorporan tarde. Un flujo que parecía eficiente puede resultar inviable por permisos, privacidad, calidad del dato, responsabilidad o falta de encaje operativo.

| Àrea | Què aporta | Cuándo debe intervenir |

|---|---|---|

| Direcció | Prioridad, marco de riesgo, asignación de recursos y decisión final. | Cuando la implantación afecta a estrategia, estructura, clientes, costes o reputación. |

| Áreas de negocio | Conocimiento del proceso, criterio de uso, calidad esperada y valor real. | Siempre que el agente afecte a trabajo operativo o decisiones del área. |

| IT | Arquitectura, seguridad, integraciones, herramientas, permisos y soporte técnico. | Desde el diseño, especialmente si hay conexión con sistemas internos. |

| Dades | Calidad, disponibilidad, estructura, gobernanza y trazabilidad de información. | Antes de alimentar agentes con datos empresariales relevantes. |

| Legal / compliance | Riesgos regulatorios, privacidad, contratos, responsabilidad y usos sensibles. | Antes de usar agentes en procesos con impacto externo, contractual o regulado. |

8.7. Cuándo tiene sentido apoyo externo

No todas las empresas tienen internamente la capacidad para diseñar, implantar y gobernar agentes con criterio. Muchas pymes y startups tienen interés, presión por avanzar y casos de uso posibles, pero no disponen de una capa interna que combine dirección, procesos, tecnología, riesgo y ejecución.

En esos casos, el apoyo externo no debería limitarse a recomendar herramientas ni a impartir formación genérica. El valor está en ordenar el trabajo: mapear procesos, detectar usos con sentido, diseñar agentes, formar responsables, establecer validaciones y acompañar la primera implantación.

Tiene sentido apoyo externo cuando…

- La empresa quiere avanzar, pero no sabe por qué procesos empezar.

- Hay uso informal de IA, pero no existe mapa, criterio ni gobierno.

- El equipo necesita formación práctica, no solo inspiración tecnológica.

- La dirección quiere mejorar productividad sin perder control sobre riesgos.

- Hace falta implantar una primera arquitectura de agentes con responsables y validación.

8.8. Qué debe quedarse una empresa de este encaje organizativo

El manager de agentes de IA no tendrá el mismo lugar en todas las empresas. En algunas será un cargo formal. En otras será una función compartida. En muchas pymes será una competencia que la dirección tendrá que asumir o reforzar externamente.

La forma puede variar. Lo que no debería variar es la responsabilidad: si los agentes empiezan a producir trabajo, acceder a datos o apoyar decisiones, alguien debe gobernar esa capacidad.

- La gestión de agentes no debe quedar solo en IT ni dispersa por áreas sin marco común.

- El encaje depende del tamaño y madurez de la empresa, pero la función debe tener dueño y autoridad.

- Dirección general debe fijar objetivos, riesgos aceptables, prioridades y métricas de valor.

- IT, datos, legal, compliance y áreas de negocio deben coordinarse desde el diseño, no al final.

- Cuando la capacidad no existe internamente, el apoyo externo debe aportar dirección, método, formación e implantación controlada.

9. Cómo empezar a gestionar agentes de IA en una pyme o startup sin crear caos

La forma más sensata de empezar con agentes de IA no es desplegarlos en toda la empresa. Es elegir un proceso concreto, acotar una tarea, definir un output, asignar un responsable humano y medir si realmente mejora tiempo, calidad, coste o fricción.

Este punto es especialmente importante en pymes, startups y empresas medianas. Tienen menos margen para absorber pilotos dispersos, herramientas duplicadas o automatizaciones que generan más trabajo del que eliminan. Por eso el primer paso debe ser pequeño, pero bien dirigido.

9.1. Elegir un proceso concreto, no una función entera

El primer error es empezar por áreas demasiado amplias: “vamos a aplicar IA en marketing”, “vamos a automatizar ventas” o “vamos a usar agentes en operaciones”. Ese enfoque abre demasiados frentes.

La unidad correcta no es el departamento. Es el proceso. Por ejemplo: clasificación de leads, preparación de propuestas, análisis de campañas, documentación de incidencias, generación de informes, revisión de oportunidades comerciales o soporte a contenidos.

Criterio de selección

El primer proceso debe ser suficientemente relevante para aportar valor, pero suficientemente acotado para poder controlarlo, medirlo y corregirlo sin alterar toda la organización.

9.2. Detectar una tarea candidata

Dentro del proceso elegido, la empresa debe identificar una tarea concreta que cumpla cinco condiciones: se repite, puede documentarse, tiene criterios de revisión, el riesgo es acotado y su mejora tendría valor real.

No se trata de empezar por tareas irrelevantes. Se trata de empezar por tareas donde el agente pueda absorber preparación, clasificación, síntesis o generación inicial sin que la empresa pierda control sobre el resultado.

| Criteri | Buena señal | Mala señal |

|---|---|---|

| Repetición | La tarea aparece con frecuencia y sigue patrones similares. | Cada caso exige una lectura completamente distinta. |

| Documentación | Existen reglas, ejemplos, criterios o materiales de referencia. | La tarea depende de conocimiento informal no explicitado. |

| Revisión | Una persona puede validar rápido si el output es correcto o útil. | Detectar errores exige demasiado tiempo o conocimiento muy especializado. |

| Risc | Un error es corregible antes de afectar a cliente, dinero o reputación. | Un error puede generar impacto externo, legal, financiero o reputacional. |

| Valor | Reducir fricción en esa tarea libera tiempo o mejora una decisión relevante. | Automatizarla apenas cambia capacidad, coste, calidad o velocidad. |

9.3. Definir el output antes de probar la herramienta

Muchas pruebas de IA fallan porque empiezan por la herramienta y no por el entregable. La empresa prueba, genera material, compara versiones y termina sin saber si el resultado es bueno o malo.

Antes de activar un agente, debe quedar claro qué debe entregar: un resumen, una clasificación, una propuesta, una tabla, una alerta, un borrador, una recomendación, un informe o una acción dentro de un sistema. También debe definirse el formato y el criterio que hará aceptable ese output.

Prueba débil

- “Veamos qué puede hacer esta herramienta”.

- El resultado esperado no está definido.

- No hay criterio claro de calidad.

- La revisión depende de impresiones subjetivas.

Prueba útil

- “Necesitamos que entregue este output concreto”.

- El formato está definido antes de empezar.

- Hay criterios de revisión.

- El resultado se compara con una situación previa.

Si la empresa no sabe qué output espera, no está implantando un agente. Está experimentando con una herramienta.

9.4. Asignar un responsable humano desde el inicio

Cada agente que intervenga en un proceso real debe tener un responsable humano. No necesariamente una persona dedicada en exclusiva, pero sí alguien que entienda el proceso, valide resultados, detecte errores, ajuste instrucciones y decida si el flujo puede escalar.

Sin responsable, el agente queda en tierra de nadie. Si funciona, todos lo usan. Si falla, nadie sabe quién debía haberlo revisado. Esa ambigüedad es una de las fuentes más habituales de riesgo en la implantación de IA.

Responsable humano

La pregunta no es solo quién configura el agente. La pregunta es quién responde por su uso dentro del proceso: qué valida, qué corrige, qué escala y qué decide no utilizar.

9.5. Aplicar una validación mínima antes de usar el output

Al inicio, conviene mantener revisión humana sobre cualquier output que pueda influir en clientes, propuestas, campañas, pricing, operaciones o decisiones internas relevantes. La autonomía debe ganarse, no concederse de entrada.

La validación puede ser sencilla. Lo importante es que exista antes de usar el output como si fuera fiable por defecto. Una checklist breve suele ser suficiente para empezar.

| Criterio de validación | Pregunta práctica |

|---|---|

| Precisió | ¿El contenido es correcto, completo y no inventa datos? |

| Font | ¿La información relevante puede verificarse? |

| Coherència | ¿Encaja con la estrategia, el proceso y el criterio de la empresa? |

| Tono | ¿Es adecuado para cliente, mercado, equipo interno o canal? |

| Risc | ¿Puede generar exposición legal, comercial, reputacional o de datos? |

| Ús | ¿Sirve para decidir, ejecutar, ajustar o descartar algo concreto? |

9.6. Medir valor real antes de escalar

Después de un primer ciclo de uso, la empresa debería poder responder con evidencias simples: cuánto tiempo se ha reducido, qué fricción ha bajado, qué calidad ha mejorado, qué errores se han evitado o qué decisión se ha preparado mejor.

Si no puede responder, el proyecto sigue en fase de experimentación. Eso no es necesariamente negativo, pero conviene llamarlo por su nombre. La implantación empieza cuando hay uso, responsable, validación y medición de impacto.

9.7. Decidir: escalar, corregir o parar

El primer piloto debe terminar en una decisión. Si el agente aporta valor, el flujo puede escalarse o replicarse en otro proceso. Si aporta valor parcial, debe corregirse. Si no aporta valor suficiente, debe detenerse antes de convertirse en otra herramienta más dentro de la empresa.

Esta disciplina es importante. Muchas empresas no fracasan porque no prueben IA. Fracasan porque prueban demasiadas cosas y no cierran ninguna con una decisión clara.

Escalar no es repetir porque algo ha gustado. Escalar es ampliar un flujo que ya ha demostrado valor y control.

9.8. Qué debe quedarse una pyme o startup de este primer paso

Empezar bien no significa empezar grande. Significa empezar con criterio. Una pyme puede capturar valor rápido si selecciona bien el proceso, define un output claro, asigna responsable, valida resultados y mide impacto.

La empresa que empieza así aprende más rápido y con menos riesgo. No convierte la IA en un experimento disperso, sino en una capacidad que puede crecer paso a paso, con dirección, utilidad y control.

- Una pyme no debe empezar implantando agentes en toda la empresa, sino en un proceso concreto y controlable.

- La primera tarea debe ser repetible, documentable, revisable, de riesgo acotado y con valor claro.

- Todo agente necesita output definido, responsable humano, validación mínima y medición de impacto.

- El primer ciclo debe terminar en una decisión: escalar, corregir o parar.

10. La nueva competencia directiva: no tener agentes, sino saber dirigirlos

La gestión de agentes de IA no debería leerse como una moda terminológica ni como una especialidad técnica aislada. Debe leerse como una nueva competencia directiva. En los próximos años, muchas empresas tendrán acceso a agentes, automatizaciones y sistemas cada vez más capaces. Eso no marcará por sí solo la diferencia.

La diferencia estará en qué empresas saben convertir esa capacidad en trabajo útil, procesos mejor diseñados, decisiones más rápidas, menos fricción operativa y más control sobre riesgos. Tener agentes será relativamente fácil. Dirigirlos bien será mucho más difícil.

10.1. La tecnología será cada vez más accesible

Las herramientas tenderán a democratizarse. Más empresas podrán generar contenido, analizar información, preparar código, producir informes, automatizar respuestas, crear prototipos o conectar flujos internos sin depender de la misma estructura que antes.

Eso abre una oportunidad clara para pymes, startups y empresas medianas. Pero también desplaza la ventaja. Si muchas empresas acceden a capacidades parecidas, la diferencia no estará solo en la herramienta, sino en la calidad del criterio con el que se aplica.

Lectura executiva

Cuando el acceso a la tecnología se iguala, la ventaja se desplaza hacia el management: qué procesos se eligen, qué tareas se delegan, qué outputs se validan y qué decisiones mejoran.

10.2. El riesgo será confundir capacidad con ventaja

Incorporar agentes puede aumentar la capacidad de producir trabajo, pero eso no equivale automáticamente a construir ventaja competitiva. Una empresa puede producir más análisis, más textos, más propuestas, más dashboards o más automatizaciones y seguir decidiendo igual de mal.

La ventaja aparece cuando esa producción se convierte en mejor ejecución: menos tiempo perdido, menos retrabajo, más claridad, mejores decisiones, procesos más consistentes y capacidad real para avanzar.

10.3. La dirección tendrá que decidir qué no automatizar

Una parte relevante del nuevo management no consistirá solo en detectar qué puede hacer la IA. Consistirá también en decidir qué no debe hacer. Esa será una competencia crítica.

No todo lo automatizable merece automatizarse. Algunas tareas requieren contexto, sensibilidad comercial, juicio reputacional, interpretación financiera, lectura política interna o responsabilidad directa ante cliente, consejo, regulador o mercado.

10.4. Cuando la capacidad no existe dentro, habrá que incorporarla

Algunas empresas desarrollarán esta competencia internamente. Otras no. En ese segundo caso, la respuesta no debería ser improvisar ni delegar el problema en una herramienta. Si la empresa quiere incorporar agentes con impacto real, necesita criterio para ponerlos en marcha.

Ese criterio puede venir de formación específica a managers, acompañamiento operativo, dirección temporal, apoyo externo en diseño de procesos o una primera implantación controlada. Lo importante es no confundir asistencia técnica con dirección del cambio. Instalar o probar herramientas no equivale a gobernar agentes.

Punto de decisión

Si la empresa no tiene internamente capacidad para mapear procesos, diseñar agentes, formar responsables, definir validaciones y medir valor, necesitará reforzar esa función antes de escalar el uso de IA.

10.5. La pregunta clave para CEOs y equipos directivos

La pregunta ya no debería ser “qué herramienta de IA usamos”. Esa pregunta es secundaria. La pregunta relevante es otra: qué parte del trabajo de la empresa debe rediseñarse y quién tiene capacidad para dirigir ese cambio.

Una empresa que responda bien a esa pregunta podrá usar agentes para aumentar capacidad sin perder control. Una empresa que la ignore puede terminar con más actividad, más producción y más ruido, pero no necesariamente con mejores resultados.

- El manager de agentes de IA no es solo un nuevo cargo: es una competencia directiva que muchas empresas deberán desarrollar.

- La tecnología será cada vez más accesible: la diferencia estará en cómo se dirige, integra, valida y gobierna.

- El verdadero cambio es organizativo: personas, agentes, procesos, herramientas y datos deberán operar como un sistema.

- Las pymes y startups tienen una oportunidad real: pueden aumentar capacidad sin inflar estructura, pero necesitan empezar con método.

- La pregunta clave no es qué agente usar: es qué trabajo rediseñar, quién lo valida y cómo se convierte en valor empresarial.

La tesis final

Una empresa con agentes mal dirigidos no será necesariamente más inteligente. Será una empresa con más producción, más velocidad y más riesgo de confundir actividad con avance.

Las empresas que sepan gobernar agentes convertirán la IA en capacidad operativa. Las que no, solo añadirán otra capa de ruido, coste y falsa productividad.

11. Preguntas frecuentes sobre manager de agentes de IA

Respuestas directas para CEOs, fundadores, directivos y responsables de área que quieren entender qué implica gestionar agentes de IA dentro de una empresa.

¿Qué es un manager de agentes de IA?

Un manager de agentes de IA es la persona o función que dirige cómo se usan agentes de inteligencia artificial dentro de una empresa. Define qué trabajo pueden asumir, qué datos utilizan, qué límites tienen, quién valida sus outputs y cómo se conectan con procesos, decisiones y resultados de negocio.

¿Es lo mismo que un prompt engineer?

No. Un prompt engineer se centra en formular mejores instrucciones para modelos de IA. El manager de agentes trabaja en una capa más amplia: procesos, tareas delegables, validación humana, riesgos, métricas de valor y responsabilidad. El prompt puede formar parte del sistema, pero no define la función.

¿Qué diferencia hay entre gestionar personas y gestionar agentes de IA?

Gestionar personas implica coordinar talento humano, prioridades, recursos y responsabilidad. Gestionar agentes añade una capa nueva: coordinar sistemas que producen trabajo, pero no tienen criterio propio ni responden por sus consecuencias. Por eso hay que definir datos, límites, validación, trazabilidad y uso del output.

¿Todas las empresas necesitarán un cargo específico de manager de agentes?